Vous pouvez lire le billet sur le blog La Minute pour plus d'informations sur les RSS !

Canaux

6888 éléments (350 non lus) dans 56 canaux

Dans la presse

(216 non lus)

Dans la presse

(216 non lus)

Du côté des éditeurs

(19 non lus)

Du côté des éditeurs

(19 non lus)

Toile géomatique francophone

(86 non lus)

Toile géomatique francophone

(86 non lus)

Géomatique anglophone

(19 non lus)

Géomatique anglophone

(19 non lus)

Dans les algorithmes (1 non lus)

-

sur Entretiens d’embauche chatbotisés

Publié: 11 July 2025, 8:30am CEST par Hubert Guillaud

Les entretiens d’embauche avec des humains sont en train de prendre fin, rapporte le New York Times en évoquant l’essor des entretiens avec des systèmes d’IA. L’expérience avec ces robots intervieweurs, comme ceux développés par Ribbon AI, Talently ou Apriora, se révèle très déshumanisante, témoignent ceux qui y sont confrontés. Les questions sont souvent un peu creuses et les chatbots ne savent pas répondre aux questions des candidats sur le poste ou sur la suite du processus de recrutement (comme si ces éléments n’étaient finalement pas importants).

A croire que l’embauche ne consiste qu’en une correspondance d’un profil à un poste, la RHTech scie assurément sa propre utilité. Quant aux biais sélectifs de ces outils, parions qu’ils sont au moins aussi défaillants que les outils de recrutements automatisés qui peinent déjà à faire des correspondances adaptées. La course au pire continue !

-

sur Scannés par l’IA

Publié: 11 July 2025, 8:23am CEST par Hubert Guillaud

Le loueur de voiture Hertz a commencé à déployer des scanneurs de voitures développées par UVeye pour inspecter les véhicules après leur location afin de vérifier leur état, explique The Drive (voir également cet article). Problème : le système est trop précis et surcharge les clients de frais pour des accrocs microscopiques qu’un être humain n’aurait pas remarqué.

Les tensions n’ont pas manqué d’éclater, et elles sont d’autant plus nombreuses qu’il est très difficile de contacter un agent de l’entreprise pour discuter ou contester les frais dans ce processus de rendu de véhicule automatisé, et que cela est impossible via le portail applicatif où les clients peuvent consulter et régler les dommages attribués à leurs locations. Des incidents d’usure mineurs ou indépendants des conducteurs, comme un éclat lié à un gravillon, sont désormais parfaitement détectés et facturés. Le problème, c’est le niveau de granularité et de précision qui a tendance a surdiagnostiquer les éraflures. Décidément, adapter les faux positifs à la réalité est partout une gageure ou un moyen pour générer des profits inédits.

-

sur L’IA, un nouvel internet… sans condition

Publié: 10 July 2025, 8:40am CEST par Hubert Guillaud

Tous les grands acteurs des technologies ont entamé leur mue. Tous se mettent à intégrer l’IA à leurs outils et plateformes, massivement. Les Big Tech se transforment en IA Tech. Et l’histoire du web, telle qu’on l’a connue, touche à sa fin, prédit Thomas Germain pour la BBC. Nous entrons dans « le web des machines », le web synthétique, le web artificiel où tous les contenus sont appelés à être générés en permanence, à la volée, en s’appuyant sur l’ensemble des contenus disponibles, sans que ceux-ci soient encore disponibles voire accessibles. Un second web vient se superposer au premier, le recouvrir… avec le risque de faire disparaître le web que nous avons connu, construit, façonné.

Jusqu’à présent, le web reposait sur un marché simple, rappelle Germain. Les sites laissaient les moteurs de recherche indexer leurs contenus et les moteurs de recherche redirigeaient les internautes vers les sites web référencés. « On estime que 68 % de l’activité Internet commence sur les moteurs de recherche et qu’environ 90 % des recherches se font sur Google. Si Internet est un jardin, Google est le soleil qui fait pousser les fleurs ».

Ce système a été celui que nous avons connu depuis les origines du web. L’intégration de l’IA, pour le meilleur ou pour le pire, promet néanmoins de transformer radicalement cette expérience. Confronté à une nette dégradation des résultats de la recherche, notamment due à l’affiliation publicitaire et au spam, le PDG de Google, Sundar Pichai, a promis une « réinvention totale de la recherche » en lançant son nouveau « mode IA ». Contrairement aux aperçus IA disponibles jusqu’à présent, le mode IA va remplacer complètement les résultats de recherche traditionnels. Désormais, un chatbot va créer un article pour répondre aux questions. En cours de déploiement et facultatif pour l’instant, à terme, il sera « l’avenir de la recherche Google ».

Un détournement massif de traficLes critiques ont montré que, les aperçus IA généraient déjà beaucoup moins de trafic vers le reste d’internet (de 30 % à 70 %, selon le type de recherche. Des analyses ont également révélé qu’environ 60 % des recherches Google depuis le lancement des aperçus sont désormais « zéro clic », se terminant sans que l’utilisateur ne clique sur un seul lien – voir les études respectives de SeerInteractive, Semrush, Bain et Sparktoro), et beaucoup craignent que le mode IA ne renforce encore cette tendance. Si cela se concrétise, cela pourrait anéantir le modèle économique du web tel que nous le connaissons. Google estime que ces inquiétudes sont exagérées, affirmant que le mode IA « rendra le web plus sain et plus utile ». L’IA dirigerait les utilisateurs vers « une plus grande diversité de sites web » et le trafic serait de « meilleure qualité » car les utilisateurs passent plus de temps sur les liens sur lesquels ils cliquent. Mais l’entreprise n’a fourni aucune donnée pour étayer ces affirmations.

Google et ses détracteurs s’accordent cependant sur un point : internet est sur le point de prendre une toute autre tournure. C’est le principe même du web qui est menacé, celui où chacun peut créer un site librement accessible et référencé.

L’article de la BBC remarque, très pertinemment, que cette menace de la mort du web a déjà été faite. En 2010, Wired annonçait « la mort du web ». A l’époque, l’essor des smartphones, des applications et des réseaux sociaux avaient déjà suscité des prédictions apocalyptiques qui ne se sont pas réalisées. Cela n’empêche pas les experts d’être soucieux face aux transformations qui s’annoncent. Pour les critiques, certes, les aperçus IA et le mode IA incluent tous deux des liens vers des sources, mais comme l’IA vous donne la réponse que vous cherchez, cliquer sur ceux-ci devient superflu. C’est comme demander un livre à un bibliothécaire et qu’il vous en parle plutôt que de vous le fournir, compare un expert.

La chute du nombre de visiteurs annoncée pourrait faire la différence entre une entreprise d’édition viable… et la faillite. Pour beaucoup d’éditeurs, ce changement sera dramatique. Nombre d’entreprises constatent que Google affiche leurs liens plus souvent, mais que ceux-ci sont moins cliqués. Selon le cabinet d’analyse de données BrightEdge, les aperçus IA ont entraîné une augmentation de 49 % des impressions sur le web, mais les clics ont chuté de 30 %, car les utilisateurs obtiennent leurs réponses directement de l’IA. « Google a écrit les règles, créé le jeu et récompensé les joueurs », explique l’une des expertes interrogée par la BBC. « Maintenant, ils se retournent et disent : « C’est mon infrastructure, et le web se trouve juste dedans ». »

Demis Hassabis, directeur de Google DeepMind, le laboratoire de recherche en IA de l’entreprise, a déclaré qu’il pensait que demain, les éditeurs alimenteraient directement les modèles d’IA avec leurs contenus, sans plus avoir à se donner la peine de publier des informations sur des sites web accessibles aux humains. Mais, pour Matthew Prince, directeur général de Cloudflare, le problème dans ce web automatisé, c’est que « les robots ne cliquent pas sur les publicités ». « Si l’IA devient l’audience, comment les créateurs seront-ils rémunérés ? » La rémunération directe existe déjà, comme le montrent les licences de contenus que les plus grands éditeurs de presse négocient avec des systèmes d’IA pour qu’elles s’entraînent et exploitent leurs contenus, mais ces revenus là ne compenseront pas la chute d’audience à venir. Et ce modèle ne passera certainement pas l’échelle d’une rétribution généralisée.

Si gagner de l’argent sur le web devient plus difficile, il est probable que nombre d’acteurs se tournent vers les réseaux sociaux pour tenter de compenser les pertes de revenus. Mais là aussi, les caprices algorithmiques et le développement de l’IA générative risquent de ne pas suffire à compenser les pertes.

Un nouvel internet sans conditionPour Google, les réactions aux aperçus IA laissent présager que le mode IA sera extrêmement populaire. « À mesure que les utilisateurs utilisent AI Overviews, nous constatons qu’ils sont plus satisfaits de leurs résultats et effectuent des recherches plus souvent », a déclaré Pichai lors de la conférence des développeurs de Google. Autrement dit, Google affirme que cela améliore la recherche et que c’est ce que veulent les utilisateurs. Mais pour Danielle Coffey, présidente de News/Media Alliance, un groupement professionnel représentant plus de 2 200 journalistes et médias, les réponses de l’IA vont remplacer les produits originaux : « les acteurs comme Google vont gagner de l’argent grâce à notre contenu et nous ne recevons rien en retour ». Le problème, c’est que Google n’a pas laissé beaucoup de choix aux éditeurs, comme le pointait Bloomberg. Soit Google vous indexe pour la recherche et peut utiliser les contenus pour ses IA, soit vous êtes désindexé des deux. La recherche est bien souvent l’une des premières utilisations de outils d’IA. Les inquiétudes sur les hallucinations, sur le renforcement des chambres d’échos dans les réponses que vont produire ces outils sont fortes (on parle même de « chambre de chat » pour évoquer la réverbération des mêmes idées et liens dans ces outils). Pour Cory Doctorow, « Google s’apprête à faire quelque chose qui va vraiment mettre les gens en colère »… et appelle les acteurs à capitaliser sur cette colère à venir. Matthew Prince de Cloudflare prône, lui, une intervention directe. Son projet est de faire en sorte que Cloudflare et un consortium d’éditeurs de toutes tailles bloquent collectivement les robots d’indexation IA, à moins que les entreprises technologiques ne paient pour le contenu. Il s’agit d’une tentative pour forcer la Silicon Valley à négocier. « Ma version très optimiste », explique Prince, « est celle où les humains obtiennent du contenu gratuitement et où les robots doivent payer une fortune pour l’obtenir ». Tim O’Reilly avait proposé l’année dernière quelque chose d’assez similaire : expliquant que les droits dérivés liés à l’exploitation des contenus par l’IA devraient donner lieu à rétribution – mais à nouveau, une rétribution qui restera par nature insuffisante, comme l’expliquait Frédéric Fillioux.

Même constat pour le Washington Post, qui s’inquiète de l’effondrement de l’audience des sites d’actualité avec le déploiement des outils d’IA. « Le trafic de recherche organique vers ses sites web a diminué de 55 % entre avril 2022 et avril 2025, selon les données de Similarweb ». Dans la presse américaine, l’audience est en berne et les licenciements continuent.

Les erreurs seront dans la réponsePour la Technology Review, c’est la fin de la recherche par mots-clés et du tri des liens proposés. « Nous entrons dans l’ère de la recherche conversationnelle » dont la fonction même vise à « ignorer les liens », comme l’affirme Perplexity dans sa FAQ. La TR rappelle l’histoire de la recherche en ligne pour montrer que des annuaires aux moteurs de recherche, celle-ci a toujours proposé des améliorations, pour la rendre plus pertinente. Depuis 25 ans, Google domine la recherche en ligne et n’a cessé de s’améliorer pour fournir de meilleures réponses. Mais ce qui s’apprête à changer avec l’intégration de l’IA, c’est que les sources ne sont plus nécessairement accessibles et que les réponses sont générées à la volée, aucune n’étant identique à une autre.

L’intégration de l’IA pose également la question de la fiabilité des réponses. L’IA de Google a par exemple expliqué que la Technology Review avait été mise en ligne en 2022… ce qui est bien sûr totalement faux, mais qu’en saurait une personne qui ne le sait pas ? Mais surtout, cet avenir génératif promet avant tout de fabriquer des réponses à la demande. Mat Honan de la TR donne un exemple : « Imaginons que je veuille voir une vidéo expliquant comment réparer un élément de mon vélo. La vidéo n’existe pas, mais l’information, elle, existe. La recherche générative assistée par l’IA pourrait théoriquement trouver cette information en ligne – dans un manuel d’utilisation caché sur le site web d’une entreprise, par exemple – et créer une vidéo pour me montrer exactement comment faire ce que je veux, tout comme elle pourrait me l’expliquer avec des mots aujourd’hui » – voire très mal nous l’expliquer. L’exemple permet de comprendre comment ce nouvel internet génératif pourrait se composer à la demande, quelque soit ses défaillances.

Mêmes constats pour Matteo Wrong dans The Atlantic : avec la généralisation de l’IA, nous retournons dans un internet en mode bêta. Les services et produits numériques n’ont jamais été parfaits, rappelle-t-il, mais la généralisation de l’IA risque surtout d’amplifier les problèmes. Les chatbots sont très efficaces pour produire des textes convaincants, mais ils ne prennent pas de décisions en fonction de l’exactitude factuelle. Les erreurs sont en passe de devenir « une des caractéristiques de l’internet ». « La Silicon Valley mise l’avenir du web sur une technologie capable de dérailler de manière inattendue, de s’effondrer à la moindre tâche et d’être mal utilisée avec un minimum de frictions ». Les quelques réussites de l’IA n’ont que peu de rapport avec la façon dont de nombreuses personnes et entreprises comprennent et utilisent cette technologie, rappelle-t-il. Plutôt que des utilisations ciblées et prudentes, nombreux sont ceux qui utilisent l’IA générative pour toutes les tâches imaginables, encouragés par les géants de la tech. « Tout le monde utilise l’IA pour tout », titrait le New York Times. « C’est là que réside le problème : l’IA générative est une technologie suffisamment performante pour que les utilisateurs en deviennent dépendants, mais pas suffisamment fiable pour être véritablement fiable ». Nous allons vers un internet où chaque recherche, itinéraire, recommandation de restaurant, résumé d’événement, résumé de messagerie vocale et e-mail sera plus suspect qu’il n’est aujourd’hui. « Les erreurs d’aujourd’hui pourraient bien, demain, devenir la norme », rendant ses utilisateurs incapables de vérifier ses fonctionnements. Bienvenue dans « l’âge de la paranoïa », clame Wired.

Vers la publicité générative et au-delà !Mais il n’y a pas que les « contenus » qui vont se recomposer, la publicité également. C’est ainsi qu’il faut entendre les déclarations de Mark Zuckerberg pour automatiser la création publicitaire, explique le Wall Street Journal. « La plateforme publicitaire de Meta propose déjà des outils d’IA capables de générer des variantes de publicités existantes et d’y apporter des modifications mineures avant de les diffuser aux utilisateurs sur Facebook et Instagram. L’entreprise souhaite désormais aider les marques à créer des concepts publicitaires de A à Z ». La publicité représente 97% du chiffre d’affaires de Meta, rappelle le journal (qui s’élève en 2024 à 164 milliards de dollars). Chez Meta les contenus génératifs produisent déjà ce qu’on attend d’eux. Meta a annoncé une augmentation de 8 % du temps passé sur Facebook et de 6 % du temps passé sur Instagram grâce aux contenus génératifs. 15 millions de publicités par mois sur les plateformes de Meta sont déjà générées automatiquement. « Grâce aux outils publicitaires développés par Meta, une marque pourrait demain fournir une image du produit qu’elle souhaite promouvoir, accompagnée d’un objectif budgétaire. L’IA créerait alors l’intégralité de la publicité, y compris les images, la vidéo et le texte. Le système déciderait ensuite quels utilisateurs Instagram et Facebook cibler et proposerait des suggestions en fonction du budget ». Selon la géolocalisation des utilisateurs, la publicité pourrait s’adapter en contexte, créant l’image d’une voiture circulant dans la neige ou sur une plage s’ils vivent en montagne ou au bord de la mer. « Dans un avenir proche, nous souhaitons que chaque entreprise puisse nous indiquer son objectif, comme vendre quelque chose ou acquérir un nouveau client, le montant qu’elle est prête à payer pour chaque résultat, et connecter son compte bancaire ; nous nous occuperons du reste », a déclaré Zuckerberg lors de l’assemblée générale annuelle des actionnaires de l’entreprise.

Nilay Patel, le rédac chef de The Verge, parle de « créativité infinie ». C’est d’ailleurs la même idée que l’on retrouve dans les propos de Jensen Huang, le PDG de Nvidia, quand il promet de fabriquer les « usines à IA » qui généreront le web demain. Si toutes les grandes entreprises et les agences de publicité ne sont pas ravies de la proposition – qui leur est fondamentalement hostile, puisqu’elle vient directement les concurrencer -, d’autres s’y engouffrent déjà, à l’image d’Unilever qui explique sur Adweek que l’IA divise par deux ses budgets publicitaires grâce à son partenariat avec Nvidia. « Unilever a déclaré avoir réalisé jusqu’à 55 % d’économies sur ses campagnes IA, d’avoir réduit les délais de production de 65% tout en doublant le taux de clic et en retenant l’attention des consommateurs trois fois plus longtemps ».

L’idée finalement très partagée par tous les géants de l’IA, c’est bien d’annoncer le remplacement du web que l’on connaît par un autre. Une sous-couche générative qu’il maîtriseraient, capable de produire un web à leur profit, qu’ils auraient avalé et digéré.

Vers des revenus génératifs ?Nilay Patel était l’année dernière l’invité du podcast d’Ezra Klein pour le New York Times qui se demandait si cette transformation du web allait le détruire ou le sauver. Dans cette discussion parfois un peu décousue, Klein rappelle que l’IA se développe d’abord là où les produits n’ont pas besoin d’être très performants. Des tâches de codage de bas niveau aux devoirs des étudiants, il est également très utilisé pour la diffusion de contenus médiocres sur l’internet. Beaucoup des contenus d’internet ne sont pas très performants, rappelle-t-il. Du spam au marketing en passant par les outils de recommandations des réseaux sociaux, internet est surtout un ensemble de contenus à indexer pour délivrer de la publicité elle-même bien peu performante. Et pour remplir cet « internet de vide », l’IA est assez efficace. Les plateformes sont désormais inondées de contenus sans intérêts, de spams, de slops, de contenus de remplissage à la recherche de revenus. Et Klein de se demander que se passera-t-il lorsque ces flots de contenu IA s’amélioreront ? Que se passera-t-il lorsque nous ne saurons plus s’il y a quelqu’un à l’autre bout du fil de ce que nous voyons, lisons ou entendons ? Y aura-t-il encore quelqu’un d’ailleurs, où n’aurons nous accès plus qu’à des contenus génératifs ?

Pour Patel, pour l’instant, l’IA inonde le web de contenus qui le détruisent. En augmentant à l’infini l’offre de contenu, le système s’apprête à s’effondrer sur lui-même : « Les algorithmes de recommandation s’effondrent, notre capacité à distinguer le vrai du faux s’effondre également, et, plus important encore, les modèles économiques d’Internet s’effondrent complètement ». Les contenus n’arrivent plus à trouver leurs publics, et inversement. L’exemple éclairant pour illustrer cela, c’est celui d’Amazon. Face à l’afflux de livres générés par l’IA, la seule réponse d’Amazon a été de limiter le nombre de livres déposables sur la plateforme à trois par jour. C’est une réponse parfaitement absurde qui montre que nos systèmes ne sont plus conçus pour organiser leurs publics et leur adresser les bons contenus. C’est à peine s’ils savent restreindre le flot

Avec l’IA générative, l’offre ne va pas cesser d’augmenter. Elle dépasse déjà ce que nous sommes capables d’absorber individuellement. Pas étonnant alors que toutes les plateformes se transforment de la même manière en devenant des plateformes de téléachats ne proposant plus rien d’autre que de courtes vidéos.

« Toutes les plateformes tendent vers le même objectif, puisqu’elles sont soumises aux mêmes pressions économiques ». Le produit des plateformes c’est la pub. Elles mêmes ne vendent rien. Ce sont des régies publicitaires que l’IA promet d’optimiser depuis les données personnelles collectées. Et demain, nos boîtes mails seront submergées de propositions marketing générées par l’IA… Pour Patel, les géants du net ont arrêté de faire leur travail. Aucun d’entre eux ne nous signale plus que les contenus qu’ils nous proposent sont des publicités. Google Actualités référence des articles écrits par des IA sans que cela ne soit un critère discriminant pour les référenceurs de Google, expliquait 404 média (voir également l’enquête de Next sur ce sujet qui montre que les sites générés par IA se démultiplient, « pour faire du fric »). Pour toute la chaîne, les revenus semblent être devenus le seul objectif.

Et Klein de suggérer que ces contenus vont certainement s’améliorer, comme la génération d’image et de texte n’a cessé de s’améliorer. Il est probable que l’article moyen d’ici trois ans sera meilleur que le contenu moyen produit par un humain aujourd’hui. « Je me suis vraiment rendu compte que je ne savais pas comment répondre à la question : est-ce un meilleur ou un pire internet qui s’annonce ? Pour répondre presque avec le point de vue de Google, est-ce important finalement que le contenu soit généré par un humain ou une IA, ou est-ce une sorte de sentimentalisme nostalgique de ma part ? »

Il y en a certainement, répond Patel. Il n’y a certainement pas besoin d’aller sur une page web pour savoir combien de temps il faut pour cuire un œuf, l’IA de Google peut vous le dire… Mais, c’est oublier que cette IA générative ne sera pas plus neutre que les résultats de Google aujourd’hui. Elle sera elle aussi façonnée par la publicité. L’enjeu demain ne sera plus d’être dans les 3 premiers résultats d’une page de recherche, mais d’être citée par les réponses construites par les modèles de langages. « Votre client le plus important, désormais, c’est l’IA ! », explique le journaliste Scott Mulligan pour la Technology Review. « L’objectif ultime n’est pas seulement de comprendre comment votre marque est perçue par l’IA, mais de modifier cette perception ». Or, les biais marketing des LLM sont déjà nombreux. Une étude montre que les marques internationales sont souvent perçues comme étant de meilleures qualités que les marques locales. Si vous demandez à un chatbot de recommander des cadeaux aux personnes vivant dans des pays à revenu élevé, il suggérera des articles de marque de luxe, tandis que si vous lui demandez quoi offrir aux personnes vivant dans des pays à faible revenu, il recommandera des marques plus cheap.

L’IA s’annonce comme un nouveau public des marques, à dompter. Et la perception d’une marque par les IA aura certainement des impacts sur leurs résultats financiers. Le marketing a assurément trouvé un nouveau produit à vendre ! Les entreprises vont adorer !

Pour Klein, l’internet actuel est certes très affaibli, pollué de spams et de contenus sans intérêts. Google, Meta et Amazon n’ont pas créé un internet que les gens apprécient, mais bien plus un internet que les gens utilisent à leur profit. L’IA propose certainement non pas un internet que les gens vont plus apprécier, bien au contraire, mais un internet qui profite aux grands acteurs plutôt qu’aux utilisateurs. Pour Patel, il est possible qu’un internet sans IA subsiste, pour autant qu’il parvienne à se financer.

Pourra-t-on encore défendre le web que nous voulons ?Les acteurs oligopolistiques du numérique devenus les acteurs oligopolistiques de l’IA semblent s’aligner pour transformer le web à leur seul profit, et c’est assurément la puissance (et surtout la puissance financière) qu’ils ont acquis qui le leur permet. La transformation du web en « web des machines » est assurément la conséquence de « notre longue dépossession », qu’évoquait Ben Tarnoff dans son livre, Internet for the People.

La promesse du web synthétique est là pour rester. Et la perspective qui se dessine, c’est que nous avons à nous y adapter, sans discussion. Ce n’est pas une situation très stimulante, bien au contraire. A mesure que les géants de l’IA conquièrent le numérique, c’est nos marges de manœuvres qui se réduisent. Ce sont elles que la régulation devrait chercher à réouvrir, dès à présent. Par exemple en mobilisant très tôt le droit à la concurrence et à l’interopérabilité, pour forcer les acteurs à proposer aux utilisateurs d’utiliser les IA de leurs choix ou en leur permettant, très facilement, de refuser leur implémentations dans les outils qu’ils utilisent, que ce soit leurs OS comme les services qu’ils utilisent. Bref, mobiliser le droit à la concurrence et à l’interopérabilité au plus tôt. Afin que défendre le web que nous voulons ne s’avère pas plus difficile demain qu’il n’était aujourd’hui.

Hubert Guillaud

Cet édito a été originellement publié dans la première lettre d’information de CaféIA le 27 juin 2025.

-

sur Renverser le pouvoir artificiel

Publié: 8 July 2025, 9:00am CEST par Hubert Guillaud

L’AI Now Institute vient de publier son rapport 2025. Et autant dire, qu’il frappe fort. “La trajectoire actuelle de l’IA ouvre la voie à un avenir économique et politique peu enviable : un avenir qui prive de leurs droits une grande partie du public, rend les systèmes plus obscurs pour ceux qu’ils affectent, dévalorise notre savoir-faire, compromet notre sécurité et restreint nos perspectives d’innovation”.

La bonne nouvelle, c’est que la voie offerte par l’industrie technologique n’est pas la seule qui s’offre à nous. “Ce rapport explique pourquoi la lutte contre la vision de l’IA défendue par l’industrie est un combat qui en vaut la peine”. Comme le rappelait leur rapport 2023, l’IA est d’abord une question de concentration du pouvoir entre les mains de quelques géants. “La question que nous devrions nous poser n’est pas de savoir si ChatGPT est utile ou non, mais si le pouvoir irréfléchi d’OpenAI, lié au monopole de Microsoft et au modèle économique de l’économie technologique, est bénéfique à la société”.

“L’avènement de ChatGPT en 2023 ne marque pas tant une rupture nette dans l’histoire de l’IA, mais plutôt le renforcement d’un paradigme du « plus c’est grand, mieux c’est », ancré dans la perpétuation des intérêts des entreprises qui ont bénéficié du laxisme réglementaire et des faibles taux d’intérêt de la Silicon Valley”. Mais ce pouvoir ne leur suffit pas : du démantèlement des gouvernements au pillage des données, de la dévalorisation du travail pour le rendre compatible à l’IA, à la réorientation des infrastructures énergétiques en passant par le saccage de l’information et de la démocratie… l’avènement de l’IA exige le démantèlement de nos infrastructures sociales, politiques et économiques au profit des entreprises de l’IA. L’IA remet au goût du jour des stratégies anciennes d’extraction d’expertises et de valeurs pour concentrer le pouvoir entre les mains des extracteurs au profit du développement de leurs empires.

Mais pourquoi la société accepterait-elle un tel compromis, une telle remise en cause ? Pour les chercheurs.ses de l’AI Now Institute ce pouvoir doit et peut être perturbé, notamment parce qu’il est plus fragile qu’il n’y paraît. “Les entreprises d’IA perdent de l’argent pour chaque utilisateur qu’elles gagnent” et le coût de l’IA à grande échelle va être très élevé au risque qu’une bulle d’investissement ne finisse par éclater. L’affirmation de la révolution de l’IA générative, elle, contraste avec la grande banalité de ses intégrations et les difficultés qu’elle engendre : de la publicité automatisée chez Meta, à la production de code via Copilot (au détriment des compétences des développeurs), ou via la production d’agents IA, en passant par l’augmentation des prix du Cloud par l’intégration automatique de fonctionnalités IA… tout en laissant les clients se débrouiller des hallucinations, des erreurs et des imperfactions de leurs produits. Or, appliqués en contexte réel les systèmes d’IA échouent profondément même sur des tâches élémentaires, rappellent les auteurs du rapport : les fonctionnalités de l’IA relèvent souvent d’illusions sur leur efficacité, masquant bien plus leurs défaillances qu’autre chose, comme l’expliquent les chercheurs Inioluwa Deborah Raji, Elizabeth Kumar, Aaron Horowitz et Andrew D. Selbst. Dans de nombreux cas d’utilisation, “l’IA est déployée par ceux qui ont le pouvoir contre ceux qui n’en ont pas” sans possibilité de se retirer ou de demander réparation en cas d’erreur.

L’IA : un outil défaillant au service de ceux qui la déploiePour l’AI Now Institute, les avantages de l’IA sont à la fois surestimés et sous-estimés, des traitements contre le cancer à une hypothétique croissance économique, tandis que certains de ses défauts sont réels, immédiats et se répandent. Le solutionnisme de l’IA occulte les problèmes systémiques auxquels nos économies sont confrontées, occultant la concentration économique à l’oeuvre et servant de canal pour le déploiement de mesures d’austérité sous prétexte d’efficacité, à l’image du très problématique chatbot mis en place par la ville New York. Des millions de dollars d’argent public ont été investis dans des solutions d’IA défaillantes. “Le mythe de la productivité occulte une vérité fondamentale : les avantages de l’IA profitent aux entreprises, et non aux travailleurs ou au grand public. Et L’IA agentive rendra les lieux de travail encore plus bureaucratiques et surveillés, réduisant l’autonomie au lieu de l’accroître”.

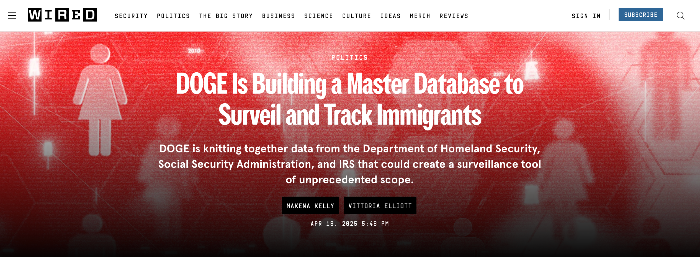

“L’utilisation de l’IA est souvent coercitive”, violant les droits et compromettant les procédures régulières à l’image de l’essor débridé de l’utilisation de l’IA dans le contrôle de l’immigration aux Etats-Unis (voir notre article sur la fin du cloisonnement des données ainsi que celui sur l’IA générative, nouvelle couche d’exploitation du travail). Le rapport consacre d’ailleurs tout un chapitre aux défaillances de l’IA. Pour les thuriféraires de l’IA, celle-ci est appelée à guérir tous nos maux, permettant à la fois de transformer la science, la logistique, l’éducation… Mais, si les géants de la tech veulent que l’IA soit accessible à tous, alors l’IA devrait pouvoir bénéficier à tous. C’est loin d’être le cas.

Le rapport prend l’exemple de la promesse que l’IA pourrait parvenir, à terme, à guérir les cancers. Si l’IA a bien le potentiel de contribuer aux recherches dans le domaine, notamment en améliorant le dépistage, la détection et le diagnostic. Il est probable cependant que loin d’être une révolution, les améliorations soient bien plus incrémentales qu’on le pense. Mais ce qui est contestable dans ce tableau, estiment les chercheurs de l’AI Now Institute, c’est l’hypothèse selon laquelle ces avancées scientifiques nécessitent la croissance effrénée des hyperscalers du secteur de l’IA. Or, c’est précisément le lien que ces dirigeants d’entreprise tentent d’établir. « Le prétexte que l’IA pourrait révolutionner la santé sert à promouvoir la déréglementation de l’IA pour dynamiser son développement ». Les perspectives scientifiques montées en promesses inéluctables sont utilisées pour abattre les résistances à discuter des enjeux de l’IA et des transformations qu’elle produit sur la société toute entière.

Or, dans le régime des défaillances de l’IA, bien peu de leurs promesses relèvent de preuves scientifiques. Nombre de recherches du secteur s’appuient sur un régime de “véritude” comme s’en moque l’humoriste Stephen Colbert, c’est-à-dire sur des recherches qui ne sont pas validées par les pairs, à l’image des robots infirmiers qu’a pu promouvoir Nvidia en affirmant qu’ils surpasseraient les infirmières elles-mêmes… Une affirmation qui ne reposait que sur une étude de Nvidia. Nous manquons d’une science de l’évaluation de l’IA générative. En l’absence de benchmarks indépendants et largement reconnus pour mesurer des attributs clés tels que la précision ou la qualité des réponses, les entreprises inventent leurs propres benchmarks et, dans certains cas, vendent à la fois le produit et les plateformes de validation des benchmarks au même client. Par exemple, Scale AI détient des contrats de plusieurs centaines de millions de dollars avec le Pentagone pour la production de modèles d’IA destinés au déploiement militaire, dont un contrat de 20 millions de dollars pour la plateforme qui servira à évaluer la précision des modèles d’IA destinés aux agences de défense. Fournir la solution et son évaluation est effectivement bien plus simple.

Autre défaillance systémique : partout, les outils marginalisent les professionnels. Dans l’éducation, les Moocs ont promis la démocratisation de l’accès aux cours. Il n’en a rien été. Désormais, le technosolutionnisme promet la démocratisation par l’IA générative via des offres dédiées comme ChatGPT Edu d’OpenAI, au risque de compromettre la finalité même de l’éducation. En fait, rappellent les auteurs du rapport, dans l’éducation comme ailleurs, l’IA est bien souvent adoptée par des administrateurs, sans discussion ni implication des concernés. A l’université, les administrateurs achètent des solutions non éprouvées et non testées pour des sommes considérables afin de supplanter les technologies existantes gérées par les services technologiques universitaires. Même constat dans ses déploiements au travail, où les pénuries de main d’œuvre sont souvent évoquées comme une raison pour développer l’IA, alors que le problème n’est pas tant la pénurie que le manque de protection ou le régime austéritaire de bas salaires. Les solutions technologiques permettent surtout de rediriger les financements au détriment des travailleurs et des bénéficiaires. L’IA sert souvent de vecteur pour le déploiement de mesures d’austérité sous un autre nom. Les systèmes d’IA appliqués aux personnes à faibles revenus n’améliorent presque jamais l’accès aux prestations sociales ou à d’autres opportunités, disait le rapport de Techtonic Justice. “L’IA n’est pas un ensemble cohérent de technologies capables d’atteindre des objectifs sociaux complexes”. Elle est son exact inverse, explique le rapport en pointant par exemple les défaillances du Doge (que nous avons nous-mêmes documentés). Cela n’empêche pourtant pas le solutionnisme de prospérer. L’objectif du chatbot newyorkais par exemple, “n’est peut-être pas, en réalité, de servir les citoyens, mais plutôt d’encourager et de centraliser l’accès aux données des citoyens ; de privatiser et d’externaliser les tâches gouvernementales ; et de consolider le pouvoir des entreprises sans mécanismes de responsabilisation significatifs”, comme l’explique le travail du Surveillance resistance Lab, très opposé au projet.

Le mythe de la productivité enfin, que répètent et anônnent les développeurs d’IA, nous fait oublier que les bénéfices de l’IA vont bien plus leur profiter à eux qu’au public. « La productivité est un euphémisme pour désigner la relation économique mutuellement bénéfique entre les entreprises et leurs actionnaires, et non entre les entreprises et leurs salariés. Non seulement les salariés ne bénéficient pas des gains de productivité liés à l’IA, mais pour beaucoup, leurs conditions de travail vont surtout empirer. L’IA ne bénéficie pas aux salariés, mais dégrade leurs conditions de travail, en augmentant la surveillance, notamment via des scores de productivité individuels et collectifs. Les entreprises utilisent la logique des gains de productivité de l’IA pour justifier la fragmentation, l’automatisation et, dans certains cas, la suppression du travail. » Or, la logique selon laquelle la productivité des entreprises mènera inévitablement à une prospérité partagée est profondément erronée. Par le passé, lorsque l’automatisation a permis des gains de productivité et des salaires plus élevés, ce n’était pas grâce aux capacités intrinsèques de la technologie, mais parce que les politiques des entreprises et les réglementations étaient conçues de concert pour soutenir les travailleurs et limiter leur pouvoir, comme l’expliquent Daron Acemoglu et Simon Johnson, dans Pouvoir et progrès (Pearson 2024). L’essor de l’automatisation des machines-outils autour de la Seconde Guerre mondiale est instructif : malgré les craintes de pertes d’emplois, les politiques fédérales et le renforcement du mouvement ouvrier ont protégé les intérêts des travailleurs et exigé des salaires plus élevés pour les ouvriers utilisant les nouvelles machines. Les entreprises ont à leur tour mis en place des politiques pour fidéliser les travailleurs, comme la redistribution des bénéfices et la formation, afin de réduire les turbulences et éviter les grèves. « Malgré l’automatisation croissante pendant cette période, la part des travailleurs dans le revenu national est restée stable, les salaires moyens ont augmenté et la demande de travailleurs a augmenté. Ces gains ont été annulés par les politiques de l’ère Reagan, qui ont donné la priorité aux intérêts des actionnaires, utilisé les menaces commerciales pour déprécier les normes du travail et les normes réglementaires, et affaibli les politiques pro-travailleurs et syndicales, ce qui a permis aux entreprises technologiques d’acquérir une domination du marché et un contrôle sur des ressources clés. L’industrie de l’IA est un produit décisif de cette histoire ». La discrimination salariale algorithmique optimise les salaires à la baisse. D’innombrables pratiques sont mobilisées pour isoler les salariés et contourner les lois en vigueur, comme le documente le rapport 2025 de FairWork. La promesse que les agents IA automatiseront les tâches routinières est devenue un point central du développement de produits, même si cela suppose que les entreprises qui s’y lancent deviennent plus processuelles et bureaucratiques pour leur permettre d’opérer. Enfin, nous interagissons de plus en plus fréquemment avec des technologies d’IA utilisées non pas par nous, mais sur nous, qui façonnent notre accès aux ressources dans des domaines allant de la finance à l’embauche en passant par le logement, et ce au détriment de la transparence et au détriment de la possibilité même de pouvoir faire autrement.

Le risque de l’IA partout est bien de nous soumettre aux calculs, plus que de nous en libérer. Par exemple, l’intégration de l’IA dans les agences chargées de l’immigration, malgré l’édiction de principes d’utilisation vertueux, montre combien ces principes sont profondément contournés, comme le montrait le rapport sur la déportation automatisée aux Etats-Unis du collectif de défense des droits des latino-américains, Mijente. Les Services de citoyenneté et d’immigration des États-Unis (USCIS) utilisent des outils prédictifs pour automatiser leurs prises de décision, comme « Asylum Text Analytics », qui interroge les demandes d’asile afin de déterminer celles qui sont frauduleuses. Ces outils ont démontré, entre autres défauts, des taux élevés d’erreurs de classification lorsqu’ils sont utilisés sur des personnes dont l’anglais n’est pas la langue maternelle. Les conséquences d’une identification erronée de fraude sont importantes : elles peuvent entraîner l’expulsion, l’interdiction à vie du territoire américain et une peine d’emprisonnement pouvant aller jusqu’à dix ans. « Pourtant, la transparence pour les personnes concernées par ces systèmes est plus que limitée, sans possibilité de se désinscrire ou de demander réparation lorsqu’ils sont utilisés pour prendre des décisions erronées, et, tout aussi important, peu de preuves attestent que l’efficacité de ces outils a été, ou peut être, améliorée ».

Malgré la légalité douteuse et les failles connues de nombre de ces systèmes que le rapport documente, l’intégration de l’IA dans les contrôles d’immigration ne semble vouée qu’à s’intensifier. L’utilisation de ces outils offre un vernis d’objectivité qui masque non seulement un racisme et une xénophobie flagrants, mais aussi la forte pression politique exercée sur les agences d’immigration pour restreindre l’asile. « L‘IA permet aux agences fédérales de mener des contrôles d’immigration de manière profondément et de plus en plus opaque, ce qui complique encore davantage la tâche des personnes susceptibles d’être arrêtées ou accusées à tort. Nombre de ces outils ne sont connus du public que par le biais de documents juridiques et ne figurent pas dans l’inventaire d’IA du DHS. Mais même une fois connus, nous disposons de très peu d’informations sur leur étalonnage ou sur les données sur lesquelles ils sont basés, ce qui réduit encore davantage la capacité des individus à faire valoir leurs droits à une procédure régulière. Ces outils s’appuient également sur une surveillance invasive du public, allant du filtrage des publications sur les réseaux sociaux à l’utilisation de la reconnaissance faciale, de la surveillance aérienne et d’autres techniques de surveillance, à l’achat massif d’informations publiques auprès de courtiers en données ». Nous sommes à la fois confrontés à des systèmes coercitifs et opaques, foncièrement défaillants. Mais ces défaillances se déploient parce qu’elles donnent du pouvoir aux forces de l’ordre, leur permettant d’atteindre leurs objectifs d’expulsion et d’arrestation. Avec l’IA, le pouvoir devient l’objectif.

Les leviers pour renverser l’empire de l’IA et faire converger les luttes contre son mondeLa dernière partie du rapport de l’AI Now Institute tente de déployer une autre vision de l’IA par des propositions, en dessinant une feuille de route pour l’action. “L’IA est une lutte de pouvoir et non un levier de progrès”, expliquent les auteurs qui invitent à “reprendre le contrôle de la trajectoire de l’IA”, en contestant son utilisation actuelle. Le rapport présente 5 leviers pour reprendre du pouvoir sur l’IA.

Démontrer que l’IA agit contre les intérêts des individus et de la société

Le premier objectif, pour reprendre la main, consiste à mieux démontrer que l’industrie de l’IA agit contre les intérêts des citoyens ordinaires. Mais ce discours est encore peu partagé, notamment parce que le discours sur les risques porte surtout sur les biais techniques ou les risques existentiels, des enjeux déconnectés des réalités matérielles des individus. Pour l’AI Now Institute, “nous devons donner la priorité aux enjeux politiques ancrés dans le vécu des citoyens avec l’IA”, montrer les systèmes d’IA comme des infrastructures invisibles qui régissent les vies de chacun. En cela, la résistance au démantèlement des agences publiques initiée par les politiques du Doge a justement permis d’ouvrir un front de résistance. La résistance et l’indignation face aux coupes budgétaires et à l’accaparement des données a permis de montrer qu’améliorer l’efficacité des services n’était pas son objectif, que celui-ci a toujours été de démanteler les services gouvernementaux et centraliser le pouvoir. La dégradation des services sociaux et la privation des droits est un moyen de remobilisation à exploiter.

La construction des data centers pour l’IA est également un nouvel espace de mobilisation locale pour faire progresser la question de la justice environnementale, à l’image de celles que tentent de faire entendre la Citizen Action Coalition de l’Indiana ou la Memphis Community Against Pollution dans le Tennessee.

La question de l’augmentation des prix et de l’inflation, et le développements de prix et salaires algorithmiques est un autre levier de mobilisation, comme le montrait un rapport de l’AI Now Institute sur le sujet datant de février qui invitait à l’interdiction pure et simple de la surveillance individualisée des prix et des salaires.

Faire progresser l’organisation des travailleurs

Le second levier consiste à faire progresser l’organisation des travailleurs. Lorsque les travailleurs et leurs syndicats s’intéressent sérieusement à la manière dont l’IA transforme la nature du travail et s’engagent résolument par le biais de négociations collectives, de l’application des contrats, de campagnes et de plaidoyer politique, ils peuvent influencer la manière dont leurs employeurs développent et déploient ces technologies. Les campagnes syndicales visant à contester l’utilisation de l’IA générative à Hollywood, les mobilisations pour dénoncer la gestion algorithmique des employés des entrepôts de la logistique et des plateformes de covoiturage et de livraison ont joué un rôle essentiel dans la sensibilisation du public à l’impact de l’IA et des technologies de données sur le lieu de travail. La lutte pour limiter l’augmentation des cadences dans les entrepôts ou celles des chauffeurs menées par Gig Workers Rising, Los Deliversistas Unidos, Rideshare Drivers United, ou le SEIU, entre autres, a permis d’établir des protections, de lutter contre la précarité organisée par les plateformes… Pour cela, il faut à la fois que les organisations puissent analyser l’impact de l’IA sur les conditions de travail et sur les publics, pour permettre aux deux luttes de se rejoindre à l’image de ce qu’à accompli le syndicat des infirmières qui a montré que le déploiement de l’IA affaiblit le jugement clinique des infirmières et menace la sécurité des patients. Cette lutte a donné lieu à une « Déclaration des droits des infirmières et des patients », un ensemble de principes directeurs visant à garantir une application juste et sûre de l’IA dans les établissements de santé. Les infirmières ont stoppé le déploiement d’EPIC Acuity, un système qui sous-estimait l’état de santé des patients et le nombre d’infirmières nécessaires, et ont contraint l’entreprise qui déployait le système à créer un comité de surveillance pour sa mise en œuvre.

Une autre tactique consiste à contester le déploiement d’IA austéritaires dans le secteur public à l’image du réseau syndicaliste fédéral, qui mène une campagne pour sauver les services fédéraux et met en lumière l’impact des coupes budgétaires du Doge. En Pennsylvanie, le SEIU a mis en place un conseil des travailleurs pour superviser le déploiement de solutions d’IA génératives dans les services publics.

Une autre tactique consiste à mener des campagnes plus globales pour contester le pouvoir des grandes entreprises technologiques, comme la Coalition Athena qui demande le démantèlement d’Amazon, en reliant les questions de surveillance des travailleurs, le fait que la multinationale vende ses services à la police, les questions écologiques liées au déploiement des plateformes logistiques ainsi que l’impact des systèmes algorithmiques sur les petites entreprises et les prix que payent les consommateurs.

Bref, l’enjeu est bien de relier les luttes entre elles, de relier les syndicats aux organisations de défense de la vie privée à celles œuvrant pour la justice raciale ou sociale, afin de mener des campagnes organisées sur ces enjeux. Mais également de l’étendre à l’ensemble de la chaîne de valeur et d’approvisionnement de l’IA, au-delà des questions américaines, même si pour l’instant “aucune tentative sérieuse d’organisation du secteur impacté par le déploiement de l’IA à grande échelle n’a été menée”. Des initiatives existent pourtant comme l’Amazon Employees for Climate Justice, l’African Content Moderators Union ou l’African Tech Workers Rising, le Data Worker’s Inquiry Project, le Tech Equity Collaborative ou l’Alphabet Workers Union (qui font campagne sur les différences de traitement entre les employés et les travailleurs contractuels).

Nous avons désespérément besoin de projets de lutte plus ambitieux et mieux dotés en ressources, constate le rapport. Les personnes qui construisent et forment les systèmes d’IA – et qui, par conséquent, les connaissent intimement – ??ont une opportunité particulière d’utiliser leur position de pouvoir pour demander des comptes aux entreprises technologiques sur la manière dont ces systèmes sont utilisés. “S’organiser et mener des actions collectives depuis ces postes aura un impact profond sur l’évolution de l’IA”.

“À l’instar du mouvement ouvrier du siècle dernier, le mouvement ouvrier d’aujourd’hui peut se battre pour un nouveau pacte social qui place l’IA et les technologies numériques au service de l’intérêt public et oblige le pouvoir irresponsable d’aujourd’hui à rendre des comptes.”

Confiance zéro envers les entreprises de l’IA !

Le troisième levier que défend l’AI Now Institute est plus radical encore puisqu’il propose d’adopter un programme politique “confiance zéro” envers l’IA. En 2023, L’AI Now, l’Electronic Privacy Information Center et d’Accountable Tech affirmaient déjà “qu’une confiance aveugle dans la bienveillance des entreprises technologiques n’était pas envisageable ». Pour établir ce programme, le rapport égraine 6 leviers à activer.

Tout d’abord, le rapport plaide pour “des règles audacieuses et claires qui restreignent les applications d’IA nuisibles”. C’est au public de déterminer si, dans quels contextes et comment, les systèmes d’IA seront utilisés. “Comparées aux cadres reposant sur des garanties basées sur les processus (comme les audits d’IA ou les régimes d’évaluation des risques) qui, dans la pratique, ont souvent eu tendance à renforcer les pouvoirs des leaders du secteur et à s’appuyer sur une solide capacité réglementaire pour une application efficace, ces règles claires présentent l’avantage d’être facilement administrables et de cibler les préjudices qui ne peuvent être ni évités ni réparés par de simples garanties”. Pour l’AI Now Institute, l’IA doit être interdite pour la reconnaissance des émotions, la notation sociale, la fixation des prix et des salaires, refuser des demandes d’indemnisation, remplacer les enseignants, générer des deepfakes. Et les données de surveillance des travailleurs ne doivent pas pouvoir pas être vendues à des fournisseurs tiers. L’enjeu premier est d’augmenter le spectre des interdictions.

Ensuite, le rapport propose de réglementer tout le cycle de vie de l’IA. L’IA doit être réglementée tout au long de son cycle de développement, de la collecte des données au déploiement, en passant par le processus de formation, le perfectionnement et le développement des applications, comme le proposait l’Ada Lovelace Institute. Le rapport rappelle que si la transparence est au fondement d’une réglementation efficace, la résistante des entreprises est forte, tout le long des développements, des données d’entraînement utilisées, aux fonctionnement des applications. La transparence et l’explication devraient être proactives, suggère le rapport : les utilisateurs ne devraient pas avoir besoin de demander individuellement des informations sur les traitements dont ils sont l’objet. Notamment, le rapport insiste sur le besoin que “les développeurs documentent et rendent publiques leurs techniques d’atténuation des risques, et que le régulateur exige la divulgation de tout risque anticipé qu’ils ne sont pas en mesure d’atténuer, afin que cela soit transparent pour les autres acteurs de la chaîne d’approvisionnement”. Le rapport recommande également d’inscrire un « droit de dérogation » aux décisions et l’obligation d’intégrer des conseils d’usagers pour qu’ils aient leur mot à dire sur les développements et l’utilisation des systèmes.

Le rapport rappelle également que la supervision des développements doit être indépendante. Ce n’est pas à l’industrie d’évaluer ce qu’elle fait. Le “red teaming” et les “models cards” ignorent les conflits d’intérêts en jeu et mobilisent des méthodologies finalement peu robustes (voir notre article). Autre levier encore, s’attaquer aux racines du pouvoir de ces entreprises et par exemple qu’elles suppriment les données acquises illégalement et les modèles entraînés sur ces données (certains chercheurs parlent d’effacement de modèles et de destruction algorithmique !) ; limiter la conservation des données pour le réentraînement ; limiter les partenariats entre les hyperscalers et les startups d’IA et le rachat d’entreprise pour limiter la constitution de monopoles.

Le rapport propose également de construire une boîte à outils pour favoriser la concurrence. De nombreuses enquêtes pointent les limites des grandes entreprises de la tech à assurer le respect du droit à la concurrence, mais les poursuites peinent à s’appliquer et peinent à construire des changements législatifs pour renforcer le droit à la concurrence et limiter la construction de monopoles, alors que toute intervention sur le marché est toujours dénoncé par les entreprises de la tech comme relevant de mesures contre l’innovation. Le rapport plaide pour une plus grande séparation structurelle des activités (les entreprises du cloud ne doivent pas pouvoir participer au marché des modèles fondamentaux de l’IA par exemple, interdiction des représentations croisées dans les conseils d’administration des startups et des développeurs de modèles, etc.). Interdire aux fournisseurs de cloud d’exploiter les données qu’ils obtiennent de leurs clients en hébergeant des infrastructures pour développer des produits concurrents.

Enfin, le rapport recommande une supervision rigoureuse du développement et de l’exploitation des centres de données, alors que les entreprises qui les développent se voient exonérées de charge et que leurs riverains en subissent des impacts disproportionnés (concurrence sur les ressources, augmentation des tarifs de l’électricité…). Les communautés touchées ont besoin de mécanismes de transparence et de protections environnementales solides. Les régulateurs devraient plafonner les subventions en fonction des protections concédées et des emplois créés. Initier des règles pour interdire de faire porter l’augmentation des tarifs sur les usagers.

Décloisonner !

Le cloisonnement des enjeux de l’IA est un autre problème qu’il faut lever. C’est le cas notamment de l’obsession à la sécurité nationale qui justifient à la fois des mesures de régulation et des programmes d’accélération et d’expansion du secteur et des infrastructures de l’IA. Mais pour décloisonner, il faut surtout venir perturber le processus de surveillance à l’œuvre et renforcer la vie privée comme un enjeu de justice économique. La montée de la surveillance pour renforcer l’automatisation “place les outils traditionnels de protection de la vie privée (tels que le consentement, les options de retrait, les finalités non autorisées et la minimisation des données) au cœur de la mise en place de conditions économiques plus justes”. La chercheuse Ifeoma Ajunwa soutient que les données des travailleurs devraient être considérées comme du « capital capturé » par les entreprises : leurs données sont utilisées pour former des technologies qui finiront par les remplacer (ou créer les conditions pour réduire leurs salaires), ou vendues au plus offrant via un réseau croissant de courtiers en données, sans contrôle ni compensation. Des travailleurs ubérisés aux travailleurs du clic, l’exploitation des données nécessite de repositionner la protection de la vie privée des travailleurs au cœur du programme de justice économique pour limiter sa capture par l’IA. Les points de collecte, les points de surveillance, doivent être “la cible appropriée de la résistance”, car ils seront instrumentalisés contre les intérêts des travailleurs. Sur le plan réglementaire, cela pourrait impliquer de privilégier des règles de minimisation des données qui restreignent la collecte et l’utilisation des données, renforcer la confidentialité (par exemple en interdisant le partage de données sur les salariés avec des tiers), le droit à ne pas consentir, etc. Renforcer la minimisation, sécuriser les données gouvernementales sur les individus qui sont de haute qualité et particulièrement sensibles, est plus urgent que jamais.

“Nous devons nous réapproprier l’agenda positif de l’innovation centrée sur le public, et l’IA ne devrait pas en être le centre”, concluent les auteurs. La trajectoire actuelle de l’IA, axée sur le marché, est préjudiciable au public alors que l’espace de solutions alternatives se réduit. Nous devons rejeter le paradigme d’une IA à grande échelle qui ne profitera qu’aux plus puissants.

L’IA publique demeure un espace fertile pour promouvoir le débat sur des trajectoires alternatives pour l’IA, structurellement plus alignées sur l’intérêt public, et garantir que tout financement public dans ce domaine soit conditionné à des objectifs d’intérêt général. Mais pour cela, encore faut-il que l’IA publique ne limite pas sa politique à l’achat de solutions privées, mais développe ses propres capacités d’IA, réinvestisse sa capacité d’expertise pour ne pas céder au solutionnisme de l’IA, favorise partout la discussion avec les usagers, cultive une communauté de pratique autour de l’innovation d’intérêt général qui façonnera l’émergence d’un espace alternatif par exemple en exigeant des méthodes d’implication des publics et aussi en élargissant l’intérêt de l’Etat à celui de l’intérêt collectif et pas seulement à ses intérêts propres (par exemple en conditionnant à la promotion des objectifs climatiques, au soutien syndical et citoyen…), ainsi qu’à redéfinir les conditions concrètes du financement public de l’IA, en veillant à ce que les investissements répondent aux besoins des communautés plutôt qu’aux intérêts des entreprises.

Changer l’agenda : pour une IA publique !

Enfin, le rapport conclut en affirmant que l’innovation devrait être centrée sur les besoins des publics et que l’IA ne devrait pas en être le centre. Le développement de l’IA devrait être guidé par des impératifs non marchands et les capitaux publics et philanthropiques devraient contribuer à la création d’un écosystème d’innovation extérieur à l’industrie, comme l’ont réclamé Public AI Network dans un rapport, l’Ada Lovelace Institute, dans un autre, Lawrence Lessig ou encore Bruce Schneier et Nathan Sanders ou encore Ganesh Sitaraman et Tejas N. Narechania… qui parlent d’IA publique plus que d’IA souveraine, pour orienter les investissement non pas tant vers des questions de sécurité nationale et de compétitivité, mais vers des enjeux de justice sociale.

Ces discours confirment que la trajectoire de l’IA, axée sur le marché, est préjudiciable au public. Si les propositions alternatives ne manquent pas, elles ne parviennent pas à relever le défi de la concentration du pouvoir au profit des grandes entreprises. « Rejeter le paradigme actuel de l’IA à grande échelle est nécessaire pour lutter contre les asymétries d’information et de pouvoir inhérentes à l’IA. C’est la partie cachée qu’il faut exprimer haut et fort. C’est la réalité à laquelle nous devons faire face si nous voulons rassembler la volonté et la créativité nécessaires pour façonner la situation différemment ». Un rapport du National AI Research Resource (NAIRR) américain de 2021, d’une commission indépendante présidée par l’ancien PDG de Google, Eric Schmidt, et composée de dirigeants de nombreuses grandes entreprises technologiques, avait parfaitement formulé le risque : « la consolidation du secteur de l’IA menace la compétitivité technologique des États-Unis. » Et la commission proposait de créer des ressources publiques pour l’IA.

« L’IA publique demeure un espace fertile pour promouvoir le débat sur des trajectoires alternatives pour l’IA, structurellement plus alignées sur l’intérêt général, et garantir que tout financement public dans ce domaine soit conditionné à des objectifs d’intérêt général ». Un projet de loi californien a récemment relancé une proposition de cluster informatique public, hébergé au sein du système de l’Université de Californie, appelé CalCompute. L’État de New York a lancé une initiative appelée Empire AI visant à construire une infrastructure de cloud public dans sept institutions de recherche de l’État, rassemblant plus de 400 millions de dollars de fonds publics et privés. Ces deux initiatives créent des espaces de plaidoyer importants pour garantir que leurs ressources répondent aux besoins des communautés et ne servent pas à enrichir davantage les ressources des géants de la technologie.

Et le rapport de se conclure en appelant à défendre l’IA publique, en soutenant les universités, en investissant dans ces infrastructures d’IA publique et en veillant que les groupes défavorisés disposent d’une autorité dans ces projets. Nous devons cultiver une communauté de pratique autour de l’innovation d’intérêt général.

***

Le rapport de l’AI Now Institute a la grande force de nous rappeler que les luttes contre l’IA existent et qu’elles ne sont pas que des luttes de collectifs technocritiques, mais qu’elles s’incarnent déjà dans des projets politiques, qui peinent à s’interelier et à se structurer. Des luttes qui sont souvent invisibilisées, tant la parole est toute entière donnée aux promoteurs de l’IA. Le rapport est extrêmement riche et rassemble une documentation à nulle autre pareille.

« L’IA ne nous promet ni de nous libérer du cycle incessant de guerres, des pandémies et des crises environnementales et financières qui caractérisent notre présent », conclut le rapport L’IA ne crée rien de tout cela, ne créé rien de ce que nous avons besoin. “Lier notre avenir commun à l’IA rend cet avenir plus difficile à réaliser, car cela nous enferme dans une voie résolument sombre, nous privant non seulement de la capacité de choisir quoi construire et comment le construire, mais nous privant également de la joie que nous pourrions éprouver à construire un avenir différent”. L’IA comme seule perspective d’avenir “nous éloigne encore davantage d’une vie digne, où nous aurions l’autonomie de prendre nos propres décisions et où des structures démocratiquement responsables répartiraient le pouvoir et les infrastructures technologiques de manière robuste, responsable et protégée des chocs systémiques”. L’IA ne fait que consolider et amplifier les asymétries de pouvoir existantes. “Elle naturalise l’inégalité et le mérite comme une fatalité, ?tout en rendant les schémas et jugements sous-jacents qui les façonnent impénétrables pour ceux qui sont affectés par les jugements de l’IA”.

Pourtant, une autre IA est possible, estiment les chercheurs.ses de l’AI Now Institute. Nous ne pouvons pas lutter contre l’oligarchie technologique sans rejeter la trajectoire actuelle de l’industrie autour de l’IA à grande échelle. Nous ne devons pas oublier que l’opinion publique s’oppose résolument au pouvoir bien établi des entreprises technologiques. Certes, le secteur technologique dispose de ressources plus importantes que jamais et le contexte politique est plus sombre que jamais, concèdent les chercheurs de l’AI Now Institute. Cela ne les empêche pas de faire des propositions, comme d’adopter un programme politique de « confiance zéro » pour l’IA. Adopter un programme politique fondé sur des règles claires qui restreignent les utilisations les plus néfastes de l’IA, encadrent son cycle de vie de bout en bout et garantissent que l’industrie qui crée et exploite actuellement l’IA ne soit pas laissée à elle-même pour s’autoréguler et s’autoévaluer. Repenser les leviers traditionnels de la confidentialité des données comme outils clés dans la lutte contre l’automatisation et la lutte contre le pouvoir de marché.

Revendiquer un programme positif d’innovation centrée sur le public, sans IA au centre.

« La trajectoire actuelle de l’IA place le public sous la coupe d’oligarques technologiques irresponsables. Mais leur succès n’est pas inéluctable. En nous libérant de l’idée que l’IA à grande échelle est inévitable, nous pouvons retrouver l’espace nécessaire à une véritable innovation et promouvoir des voies alternatives stimulantes et novatrices qui exploitent la technologie pour façonner un monde au service du public et gouverné par notre volonté collective ».

La trajectoire actuelle de l’IA vers sa suprématie ne nous mènera pas au monde que nous voulons. Sa suprématie n’est pourtant pas encore là. “Avec l’adoption de la vision actuelle de l’IA, nous perdons un avenir où l’IA favoriserait des emplois stables, dignes et valorisants. Nous perdons un avenir où l’IA favoriserait des salaires justes et décents, au lieu de les déprécier ; où l’IA garantirait aux travailleurs le contrôle de l’impact des nouvelles technologies sur leur carrière, au lieu de saper leur expertise et leur connaissance de leur propre travail ; où nous disposons de politiques fortes pour soutenir les travailleurs si et quand les nouvelles technologies automatisent les fonctions existantes – y compris des lois élargissant le filet de sécurité sociale – au lieu de promoteurs de l’IA qui se vantent auprès des actionnaires des économies réalisées grâce à l’automatisation ; où des prestations sociales et des politiques de congés solides garantissent le bien-être à long terme des employés, au lieu que l’IA soit utilisée pour surveiller et exploiter les travailleurs à tout va ; où l’IA contribue à protéger les employés des risques pour la santé et la sécurité au travail, au lieu de perpétuer des conditions de travail dangereuses et de féliciter les employeurs qui exploitent les failles du marché du travail pour se soustraire à leurs responsabilités ; et où l’IA favorise des liens significatifs par le travail, au lieu de favoriser des cultures de peur et d’aliénation.”

Pour l’AI Now Institute, l’enjeu est d’aller vers une prospérité partagée, et ce n’est pas la direction que prennent les empires de l’IA. La prolifération de toute nouvelle technologie a le potentiel d’accroître les opportunités économiques et de conduire à une prospérité partagée généralisée. Mais cette prospérité partagée est incompatible avec la trajectoire actuelle de l’IA, qui vise à maximiser le profit des actionnaires. “Le mythe insidieux selon lequel l’IA mènera à la « productivité » pour tous, alors qu’il s’agit en réalité de la productivité d’un nombre restreint d’entreprises, nous pousse encore plus loin sur la voie du profit actionnarial comme unique objectif économique. Même les politiques gouvernementales bien intentionnées, conçues pour stimuler le secteur de l’IA, volent les poches des travailleurs. Par exemple, les incitations gouvernementales destinées à revitaliser l’industrie de la fabrication de puces électroniques ont été contrecarrées par des dispositions de rachat d’actions par les entreprises, envoyant des millions de dollars aux entreprises, et non aux travailleurs ou à la création d’emplois. Et malgré quelques initiatives significatives pour enquêter sur le secteur de l’IA sous l’administration Biden, les entreprises restent largement incontrôlées, ce qui signifie que les nouveaux entrants ne peuvent pas contester ces pratiques.”

“Cela implique de démanteler les grandes entreprises, de restructurer la structure de financement financée par le capital-risque afin que davantage d’entreprises puissent prospérer, d’investir dans les biens publics pour garantir que les ressources technologiques ne dépendent pas des grandes entreprises privées, et d’accroître les investissements institutionnels pour intégrer une plus grande diversité de personnes – et donc d’idées – au sein de la main-d’œuvre technologique.”

“Nous méritons un avenir technologique qui soutienne des valeurs et des institutions démocratiques fortes.” Nous devons de toute urgence restaurer les structures institutionnelles qui protègent les intérêts du public contre l’oligarchie. Cela nécessitera de s’attaquer au pouvoir technologique sur plusieurs fronts, et notamment par la mise en place de mesures de responsabilisation des entreprises pour contrôler les oligarques de la tech. Nous ne pouvons les laisser s’accaparer l’avenir.

Sur ce point, comme sur les autres, nous sommes d’accord.

Hubert Guillaud

-

sur Pour lutter contre la désinformation, il faut reconstruire du social

Publié: 7 July 2025, 9:00am CEST par Hubert Guillaud

L’Institut Nicod publie un court et très stimulant rapport sur la désinformation signé Grégoire Darcy. Non seulement celui-ci débogue la simplicité des réponses cognitives que les politiques publiques ont tendance à proposer, mais surtout, repolitise la question.

Le rapport rappelle que la désinformation n’est pas seulement un problème d’irrationnalité et de crédulité. Il invite à sortir de l’approche réactive qui se concentre sur les symptômes et qui se focalise bien trop sur les modalités de diffusion oubliant les mécanismes affectifs et sociaux qui expliquent l’adhésion aux récits trompeurs. La lutte contre la désinformation repose sur une vision simpliste de la psychologie humaine : « la désinformation répond à des besoins sociaux, émotionnels et identitaires plus qu’à de simples déficits de rationalité. Ainsi, corriger les erreurs factuelles ne suffit pas : il faut s’attaquer aux conditions qui rendent ces récits socialement fonctionnels. » La désinformation n’est que le symptôme de la dégradation globale de l’écosystème informationnel. « Les vulnérabilités face à la désinformation ne tiennent pas qu’aux dispositions individuelles, mais s’ancrent dans des environnements sociaux, économiques et médiatiques spécifiques : isolement social, précarité, homogamie idéologique et défiance institutionnelle sont des facteurs clés expliquant l’adhésion, bien au-delà des seuls algorithmes ou biais cognitifs ».

“Tant que les politiques publiques se contenteront de réponses réactives, centrées sur les symptômes visibles et ignorantes des dynamiques cognitives, sociales et structurelles à l’œuvre, elles risquent surtout d’aggraver ce qu’elles prétendent corriger. En cause : un modèle implicite, souvent naïf, de la psychologie humaine – un schéma linéaire et individualisant, qui réduit l’adhésion aux contenus trompeurs à un simple déficit d’information ou de rationalité. Ce cadre conduit à des politiques fragmentées, peu efficaces, parfois même contre-productive.”

Les réponses les plus efficientes à la désinformation passent par une transformation structurelle de l’écosystème informationnel, que seule l’action publique peut permettre, en orchestrant à la fois la régulation algorithmique et le renforcement des médias fiables. La réduction des vulnérabilités sociales, économiques et institutionnelles constitue l’approche la plus structurante pour lutter contre la désinformation, en s’attaquant aux facteurs qui nourrissent la réceptivité aux contenus trompeurs – précarité, marginalisation, polarisation et défiance envers les institutions. Parmi les mesures que pointe le rapport, celui-ci invite à une régulation forte des réseaux sociaux permettant de « restituer la maîtrise du fil par une transparence algorithmique accrue et une possibilité de maîtriser » les contenus auxquels les gens accèdent : « rendre visibles les critères de recommandation et proposer par défaut un fil chronologique permettrait de réduire les manipulations attentionnelles sans recourir à la censure ». Le rapport recommande également « d’assurer un financement stable pour garantir l’indépendance des médias et du service public d’information ». Il recommande également de renforcer la protection sociale et les politiques sociales pour renforcer la stabilité propice à l’analyse critique. D’investir dans le développement d’espace de sociabilité et de favoriser une circulation apaisée de l’information en renforçant l’intégrité publique.

Un rapport stimulant, qui prend à rebours nos présupposés et qui nous dit que pour lutter contre la désinformation, il faut lutter pour rétablir une société juste.

-

sur La santé au prisme de son abandon

Publié: 3 July 2025, 8:55am CEST par Hubert Guillaud

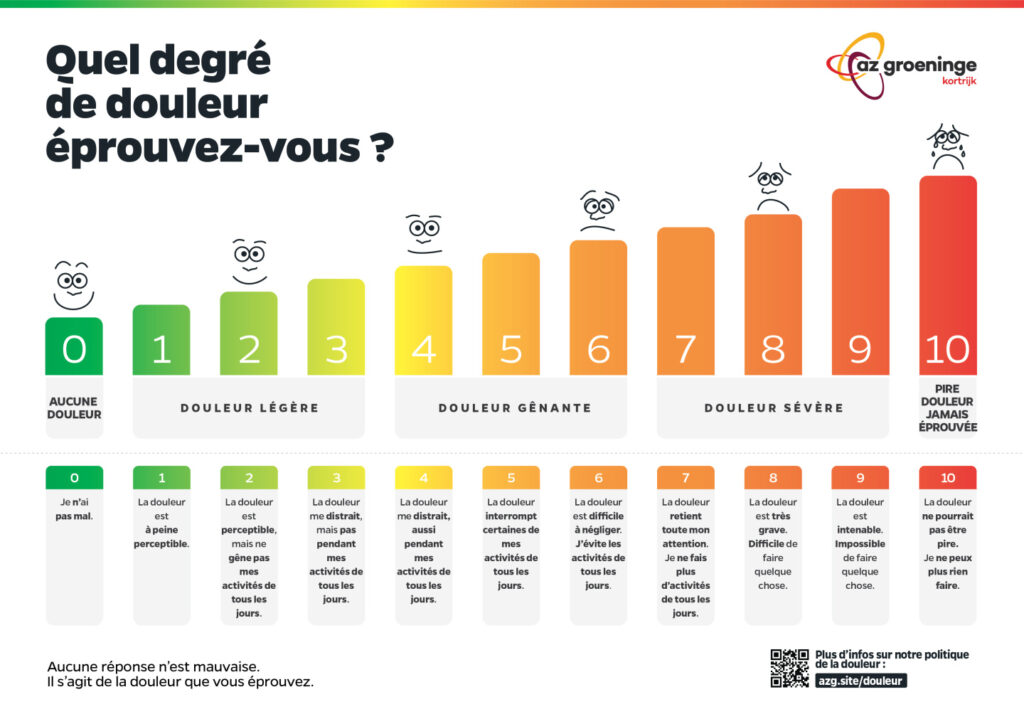

Dans AOC, le philosophe Alexandre Monnin, auteur de Politiser le renoncement (Divergences, 2023) explique que “derrière les discours d’efficience, d’autonomie et de prévention, un glissement insidieux s’opère : celui d’une médecine qui renonce à soigner”. Le soin est en train de devenir conditionnel, réservé aux existences jugées “optimisables”. La stratégie de non-soin, n’est pas que la conséquence des restrictions budgétaires ou de la désorganisation du secteur, mais une orientation active, un projet politique. Comme c’est le cas au travers du programme américain MAHA (Make America Healthy Again), dont l’ambien n’est plus de soigner, mais d’éviter les coûts liés au soin, ou la loi sur le droit à mourir récemment adoptée en France, dénoncée par les collectifs antivalidistes comme une manière d’acter l’impossibilité de vivre avec certains handicaps ou maladies chroniques. “Ce tournant ne se donne pas toujours pour ce qu’il est. Il s’abrite derrière les mots d’efficacité, d’autonomie, de prévention, voire de soutenabilité. Il s’appuie sur des cadres comme le paradigme One Health, censé penser la santé de manière systémique à l’échelle des écosystèmes mais qui, en pratique, contribue à diluer les responsabilités et à rendre invisibles les enjeux de justice sociale.” Nous entrons dans une médicalisation sans soins, où l’analyse de santé se détache de toute thérapeutique.

Pour Derek Beres de Conspirituality, nous entrons dans une ère de “soft eugenics”, d’eugénisme doux. Le self-care propose désormais à chacun de mesurer sa santé pour en reprendre le contrôle, dans une forme de “diagnostics sans soins”, qui converge avec les vues antivax de Robert Kennedy Jr, le ministre de la Santé américain, critiquant à la fois la surmédicalisation et la montée des maladies chroniques renvoyées à des comportements individuels. En mettant l’accent sur la prévention et la modification des modes de vies, cet abandon de la santé renvoie les citoyens vers leurs responsabilités et la santé publique vers des solutions privées, en laissant sur le carreau les populations vulnérables. Cette médecine du non-soin s’appuie massivement sur des dispositifs technologiques sophistiqués proches du quantified self, “vidée de toute relation clinique”. “Ces technologies alimentent des systèmes d’optimisation où l’important n’est plus la guérison, mais la conformité aux normes biologiques ou comportementales. Dans ce contexte, le patient devient un profil de risque, non plus un sujet à accompagner. La plateformisation du soin réorganise en profondeur les régimes d’accès à la santé. La médecine n’est alors plus un service public mais une logistique de gestion différenciée des existences.”

C’est le cas du paradigme One Health, qui vise à remplacer le soin par une idéalisation holistique de la santé, comme un état d’équilibre à maintenir, où l’immunité naturelle affaiblit les distinctions entre pathogène et environnement et favorise une démission institutionnelle. “Face aux dégradations écologiques, le réflexe n’est plus de renforcer les capacités collectives de soin. Il s’agit désormais de retrouver une forme de pureté corporelle ou environnementale perdue. Cette quête se traduit par l’apologie du jeûne, du contact avec les microbes, de la « vitalité » naturelle – et la dénonciation des traitements, des masques, des vaccins comme autant d’artefacts « toxiques ». Elle entretient une confusion entre médecine industrielle et médecine publique, et reformule le soin comme une purification individuelle. Là encore, le paradigme du non-soin prospère non pas en contradiction avec l’écologie, mais bien davantage au nom d’une écologie mal pensée, orientée vers le refus de l’artifice plutôt que vers l’organisation solidaire de la soutenabilité.” “L’appel à « ne pas tomber malade » devient un substitut direct au droit au soin – voire une norme visant la purification des plus méritants dans un monde saturé de toxicités (et de modernité).”

“Dans ce monde du non-soin, l’abandon n’est ni un effet secondaire ni une faute mais un principe actif de gestion.” Les populations vulnérables sont exclues de la prise en charge. Sous forme de scores de risques, le tri sanitaire technicisé s’infiltre partout, pour distinguer les populations et mettre de côté ceux qui ne peuvent être soignés. “La santé publique cesse d’être pensée comme un bien commun, et devient une performance individuelle, mesurée, scorée, marchandée. La médecine elle-même, soumise à l’austérité, finit par abandonner ses missions fondamentales : observer, diagnostiquer, soigner. Elle se contente de prévenir – et encore, seulement pour ceux qu’on juge capables – et/ou suffisamment méritants.” Pour Monnin, cet accent mis sur la prévention pourrait être louable si elle ne se retournait pas contre les malades : “Ce n’est plus la santé publique qui se renforce mais une responsabilité individualisée du « bien se porter » qui légitime l’abandon de celles et ceux qui ne peuvent s’y conformer. La prévention devient une rhétorique de la culpabilité, où le soin est indexé sur la conformité à un mode de vie puissamment normé”.

Pour le philosophe, le risque est que le soin devienne une option, un privilège.

Le problème est que ces nouvelles politiques avancent sous le masque de l’innovation et de la prévention, alors qu’elles ne parlent que de responsabilité individuelle, au risque de faire advenir un monde sans soin qui refuse d’intervenir sur les milieux de vies, qui refuse les infrastructures collectives, qui renvoie chacun à l’auto-surveillance “sans jamais reconstruire les conditions collectives du soin ni reconnaître l’inégale capacité des individus à le faire”. Un monde où ”la surveillance remplace l’attention, la donnée remplace la relation, le test remplace le soin”. Derrière le tri, se profile “une santé sans soin, une médecine sans clinique – une écologie sans solidarité”.

“L’État ne disparaît pas : il prescrit, organise, finance, externalise. Il se fait plateforme, courtier de services, émetteur d’appels à projets. En matière de santé, cela signifie le financement de dispositifs de prévention algorithmique, l’encouragement de solutions « innovantes » portées par des start-ups, ou encore le remboursement indirect de produits encore non éprouvés. Ce nouveau régime n’est pas une absence de soin, c’est une délégation programmée du soin à des acteurs dont l’objectif premier n’est pas le soin mais la rentabilité. L’État ne s’efface pas en totalité : il administre la privatisation du soin.”

-

sur IA et éducation (2/2) : du dilemme moral au malaise social

Publié: 1 July 2025, 8:41am CEST par Hubert Guillaud

Suite de notre dossier sur IA et éducation (voir la première partie).