Vous pouvez lire le billet sur le blog La Minute pour plus d'informations sur les RSS !

Canaux

5200 éléments (38 non lus) dans 55 canaux

Dans la presse

(12 non lus)

Dans la presse

(12 non lus)

Du côté des éditeurs

(3 non lus)

Du côté des éditeurs

(3 non lus)

Toile géomatique francophone

(23 non lus)

Toile géomatique francophone

(23 non lus)

Toile géomatique francophone

Toile géomatique francophone

-

sur [MUSCATE & THEIA] Production of Sentinel-2 L2A is late

Publié: 5 September 2023, 6:19pm CEST par Olivier Hagolle

Update on 25 september 2023 : we have no backlog left in Europe, and the system is catching up on the other regions of the world

Update on 9 september 2023 : 25 days processed in a week over France ! We are catching up a bit

CNES has bought and built a new HPC cluster, named T-Rex, that will soon replace the former one, HAL. T-Rex will drastically improve our processing capacity ! T-Rex started its operations this summer, but the transition is complex, as T-Rex reuses the most powerful nodes of HAL, needs a synchronisation of all the data sets (the data volumes to copy are huge), and of course, has a different OS version and a new scheduler. We have anticipated the changes in our systems, using a simulated environment to test our softwares, but, you know, simulations are not the reality.

As a result, the production of MUSCATE (THEIA) is still running on HAL, but some of the best processors of HAL have been migrated to T-REX, reducing our production capacity. moreover, we have been asked to stop producing on week-ends, to allow a faster copy of the data from HAL to T-Rex.

As a result, yet, we have not been able to catch-up the production that we had halted for a few weeks when the new version of CAMS was put in production, and for some sites, for instance, in France, we are late by one month. Please be assured that the teams are doing their best to catch it up.

-

sur L'histoire par les cartes : une carte japonaise du XVIIe raconte le voyage d'Edo à Kyoto

Publié: 5 September 2023, 6:13am CEST

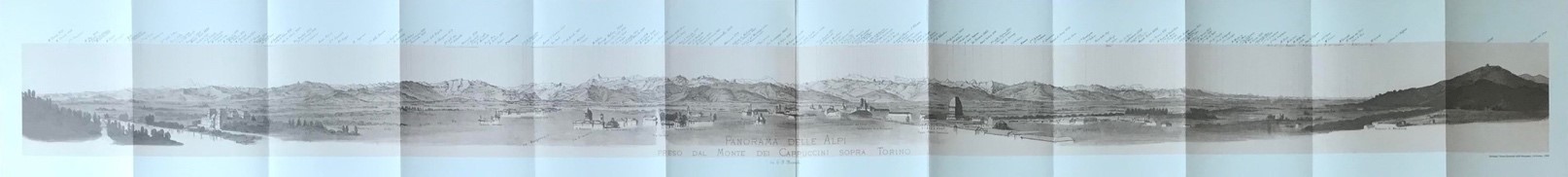

Source : The Scenic Route? The Library’s 117-foot Map from 17th-century Japan, 21 août 2023 (Library of Congress Blogs)Bien avant l'avènement de Google Earth et des livres de voyage, des cartes illustées servaient à guider les voyageurs sur leur route. La carte T?kaid? bunken ezu, peinte sur deux rouleaux, mesure plus de 3,6 mètres de long. La carte en rouleau illustré date de 1690. Elle est à découvrir sur le site de la Bibliothèque du Congrès.

Extrait de la carte "T?kaid? bunken ezu" à découvrir sur le site de la Bibliothèque du Congrès

Le cartographe Ochikochi Doin a étudié en 1651 la route de près de 500 km qui relie Edo (maintenant connue sous le nom de Tokyo) à Kyoto, et le célèbre artiste Hishikawa Moronobu a donné forme à ses découvertes en 1690 via cette carte illustrée à la plume et à l'encre. Une version non colorée est visible sur le site du British Museum. L'Université de Manchester en propose également une réimpression ultérieure.

La carte est un d?ch?zu (« carte routière ») imprimé sur bois. Elle reproduit les 486 kilomètres de ce parcours à une échelle de 1:12000. La carte représente cinq tronçons principaux de la route du Tokaido, fournissant un compte rendu détaillé des commodités, des points de repère et du terrain avec en fond des images de montagnes, de rivières et de mers. Elle montre les 53 stations ou villes postales, qui bordaient l'itinéraire pour fournir aux voyageurs hébergement et nourriture. Des monuments célèbres tels que le Mt Fuji et le Mt Oyama sont représentés sous plusieurs angles et à différentes stations.

Extraits du parchemin à découvrir sur le site de la Bibliothèque du Congrès

La carte emprunte au genre japonais de l’emaki (???, littéralement « rouleau peint »), noté souvent e-maki, un système de narration horizontale illustrée dont les origines remontent au VIIIe siècle au Japon.

La carte "T?kaid? bunken ezu", élaborée à la manière d'un guide quotidien comme pour un road trip, est aujourd'hui reconnue comme un grand artefact culturel : il est considéré comme un chef-d'œuvre de la cartographie japonaise.

Pour compléter

Les plus anciennes cartes itinéraires japonaises, ou Dochuzu, remontent au XVIIe siècle et suivent divers modèles durant la période d'Edo. Certaines adoptent une forme diagrammatique pour représenter les principaux axes de circulation terrestre de l'archipel, dont les célèbres Gokaid? conçues et développées au cours du shogunat Tokugawa. Longues de plusieurs centaines de kilomètres, ces cinq routes majeures, partant de la ville d'Edo sont jalonnées de stations (shukuba) comportant auberges, postes de contrôle et relais de chevaux. Achevé dès 1624, le T?kaid?, qui relie Edo à Ky?to, est la plus importante et la plus fréquentée d'entre elles : représentant une distance totale d'environ 500 km, longeant par endroits le littoral, la « route de la mer de l'Est », et ses cinquante-trois étapes, a inspiré de nombreux maîtres de l'estampe (Hokusai, Hiroshige). Source : Le Japon et la mer. Une cartographie asiatique (Paris Sorbonne)

Le médecin et naturaliste Philip Franz Siebold (1796-1866), qui a rassemblé une importante collection de cartes sur le Japon au XIXe, a produit une très belle carte de voyage « Mont Fuji et T?kaid? - Route de la mer orientale » (1840), d'après un livre de voyage japonais gravé sur bois en couleur du début du XVIIIe siècle. A découvrir sur le site de la collection David Rumsey.

Articles connexes

L'histoire par les cartes : la collection de cartes japonaises de la Manchester University Library

L'histoire par les cartes : une carte japonaise de l'Afrique du début de l'ère Meiji (1876)L'histoire par les cartes : l'Asie du Sud-Est à travers des cartes japonaises de la 2e Guerre mondiale

Signaler les enfants bruyants dans sa rue : Dorozoku, un site cartographique controversé au Japon

Cartes et données sur les tremblements de terre au Japon depuis 1923

Comprendre la mégapole japonaise en utilisant le site "To?kyo?, portraits et fictions"

Carte des road trips les plus épiques de la littérature américaine

-

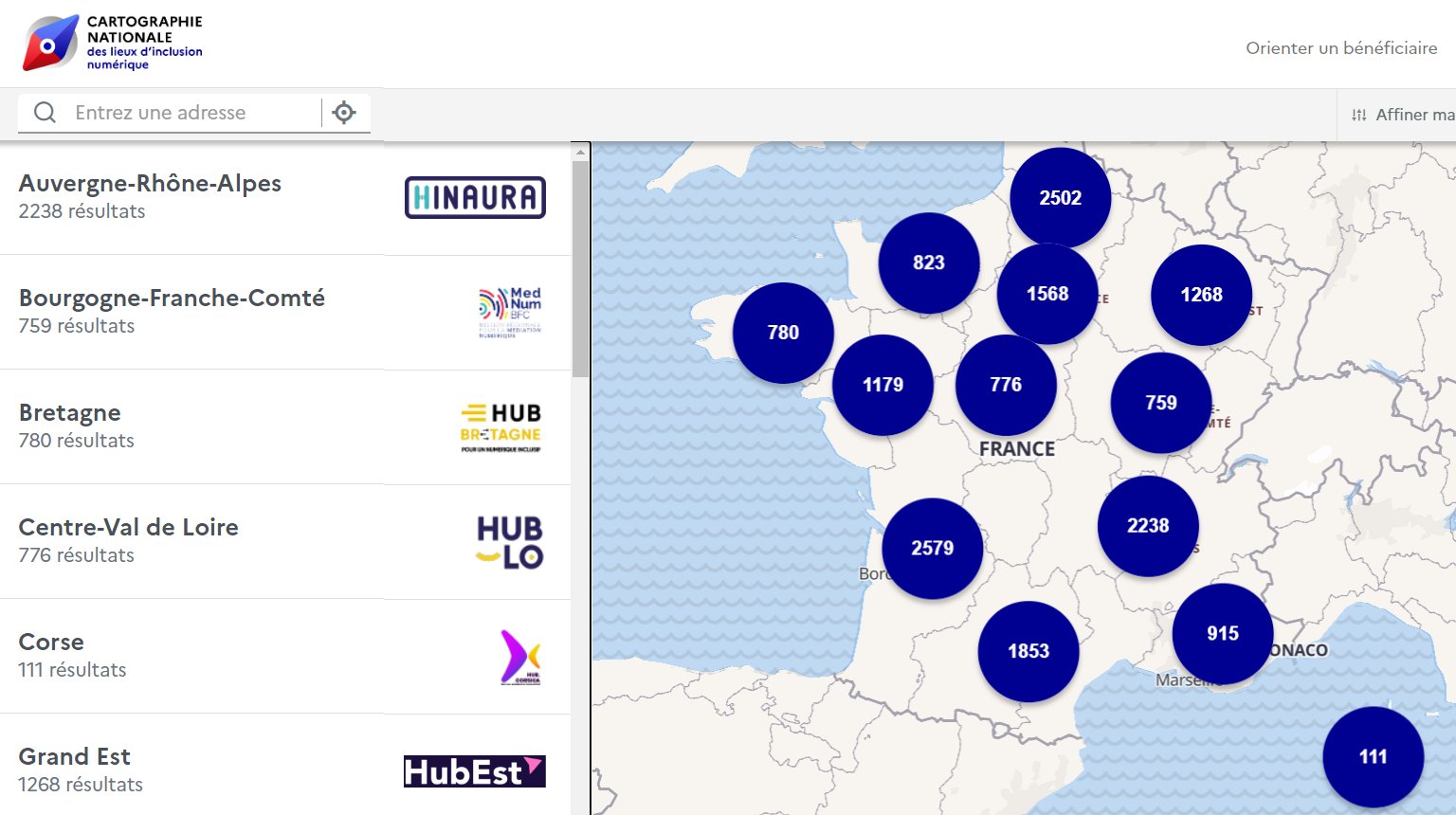

sur Cartographie nationale des lieux d'inclusion numérique

Publié: 4 September 2023, 4:29pm CEST

La Cartographie nationale des lieux d'inclusion numérique agrège une 30e de jeux de données et compte près de 18 000 structures. Elle permet d'identifier, localiser et mettre en avant les centres et les espaces qui proposent un accompagnement et des ressources pour aider les citoyens à développer leurs compétences numériques. Le travail est piloté par l’Agence nationale pour la cohésion des territoires (ANCT) et La MedNum avec l’appui de Datactivist.

Accès aux lieux d'inclusion numérique par région sur le portail cartographie.societenumerique.gouv.frLa large diffusion de la Cartographie permet de :

- contribuer à une meilleure orientation des bénéficiaires de services de médiation numérique ;

- promouvoir l'inclusion numérique, en mettant en avant les espaces d'inclusion numérique de notre territoire ;

- faciliter les partenariats locaux : la collaboration avec diverses organisations pour le déploiement de cet outil peut favoriser des partenariats solides et durables au sein de votre écosystème local.

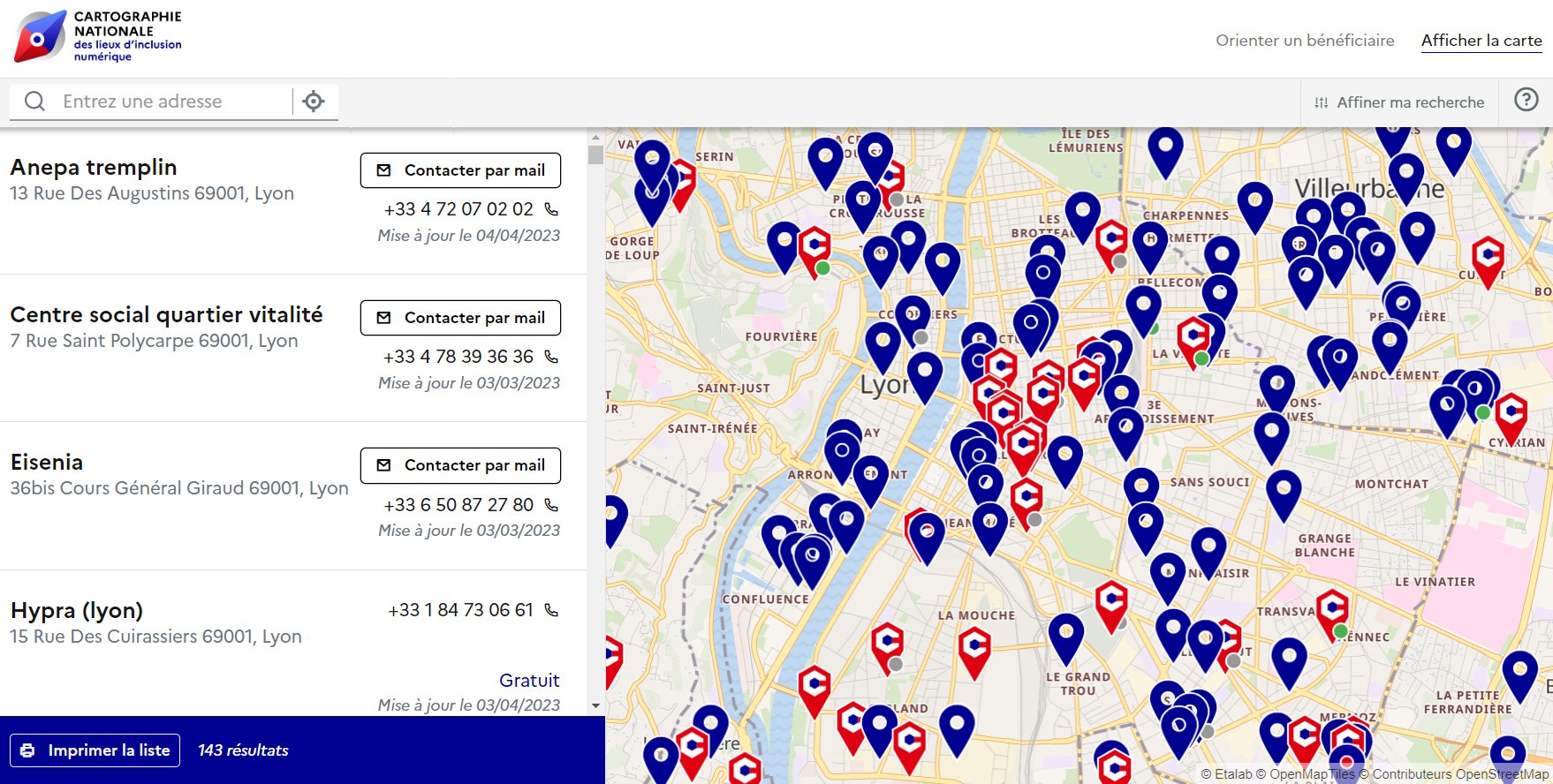

Zoom sur un territoire permettant de repérer les lieux où l'on trouve un Conseiller numérique (en rouge)

Le schéma répond aux spécifications du schéma "Lieux de médiation numérique" élaboré collaborativement et disponible sur le site schema.data.gouv.fr. Il existe un réel besoin d’une vision nationale, complète et actualisée de l’offre de médiation numérique. Des acteurs de la médiation numérique, notamment les hubs, ont produit de nombreuses données de recensement des lieux et des offres de médiation mais souvent, ces productions ne respectent pas le même format, rendant alors impossible une vision formalisée, complète et partagée de l’offre nationale de médiation numérique. La standardisation permet de décrire l'offre de médiation numérique de manière harmonisée. Elle repose sur un travail de concertation dans lequel des utilisateurs représentatifs ont défini un schéma de données qui décrit le format des fichiers, les différents champs, les valeurs possibles.

Le jeu de données fourni par Data Inclusion est disponible au format json et csv sur Data.gouv.fr.

Une rapide représentation cartographique des données montre la forte inégalité dans la répartition des lieux d'inclusion numérique à l'échelle nationale (à recroiser avec la répartition de la population française). La base de données permet de mettre en évidence la diversité des lieux d'accueil (mairies, médiathèques, centres sociaux, maisons de quartier, missions locales, associations, fablabs...).rd-mediation-num/

La stratégie nationale pour un numérique inclusif, initiée en 2018, a permis l’émergence et le développement de nombreux dispositifs dédiés à l’accompagnement des 14 millions de Françaises et de Français en fragilité avec le numérique, sous l’impulsion de l’Agence nationale de la cohésion des territoires (ANCT). La création de La MedNum participait de cette stratégie, pour structurer l’offre de médiation numérique et participer à la consolidation économique comme à l’augmentation de la capacité d’action des acteurs et actrices de ce secteur. Les évolutions de ces dernières années semblent cependant participer à une reconfiguration de cet écosystème : crise sanitaire, généralisation de la dématérialisation, déploiement d'infrastructures numériques, recrutement massif de 4000 conseillers et conseillères numériques, mise en œuvre de solutions numériques pour les aidants et aidantes et installation sur les territoires de Hubs territoriaux pour un numérique inclusif. Afin d'accompagner ces évolations a été mis en place en 2022 un Observatoire de l'inclusion numérique qui est au coeur des missions de La MedNum.

Articles connexes

Infrastructures numériques : un accès encore inégal selon les pays

Cartographier les données des tests PISA : quelle lecture géographique des inégalités en matière d'éducation ?

Étudier les inégalités entre établissements scolaires à partir de l'Indice de position sociale (IPS)

Rapport sur les inégalités mondiales 2022 (World Inequality Lab)

Des inégalités dans l'équipement informatique des écoles primaires en France et outre-mer (rapport CNESCO, octobre 2020)

Un atlas des fractures scolaires par Patrice Caro et Rémi Rouault : comment lire et analyser les inégalités socio-spatiales en éducation ?

La cartographie des inégalités à travers l'Indice de privation multiple au Royaume-Uni (rapport 2019)

Géographies de l'exclusion numérique par Mark Graham et Martin Dittus

Monroe Work et la visualisation des inégalités scolaires dans l'entre-deux-guerres aux Etats-Unis

-

sur QGIS rencontre AWS S3

Publié: 4 September 2023, 10:50am CEST par Jacky Volpes

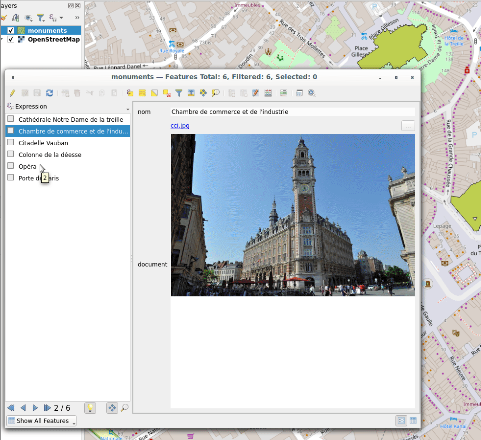

Depuis QGIS 3.22 Bia?owie?a, il est possible de lier des documents externes (documents stockés sur des plateformes utilisant le protocole WebDAV, telles que Nextcloud, Pydio, etc.) à des données géographiques. Cette fonctionnalité permet d’introduire une composante de Gestion Électronique de Documents (GED) dans les SIG.

La livraison de cette fonctionnalité auprès de la communauté QGIS s’est faite grâce au financement de la Métropole de Lille, et elle se voit aujourd’hui enrichie grâce à l’implication et au financement de la Métropole de Lyon qui utilise une infrastructure de GED basée sur le stockage d’objets dans le cloud, qu’elle souhaite pouvoir exploiter à travers son SIG.

C’est un bel exemple de cercle vertueux où des utilisateurs mutualisent des financements afin d’enrichir les fonctionnalités de QGIS au bénéfice du plus grand nombre : les contributions se sont enchainées pour améliorer les jalons posés par d’autres utilisateurs.

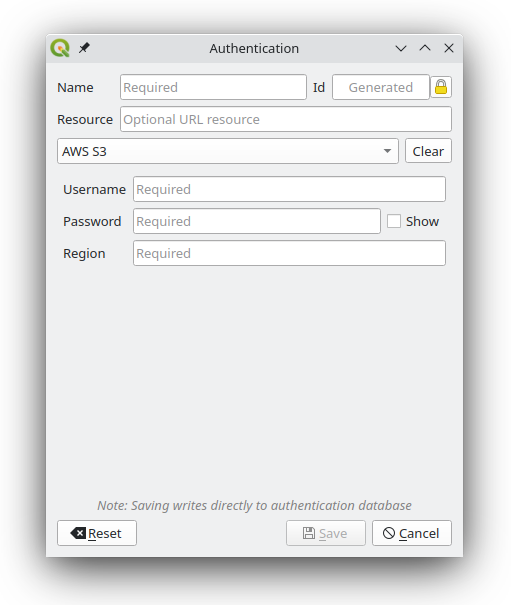

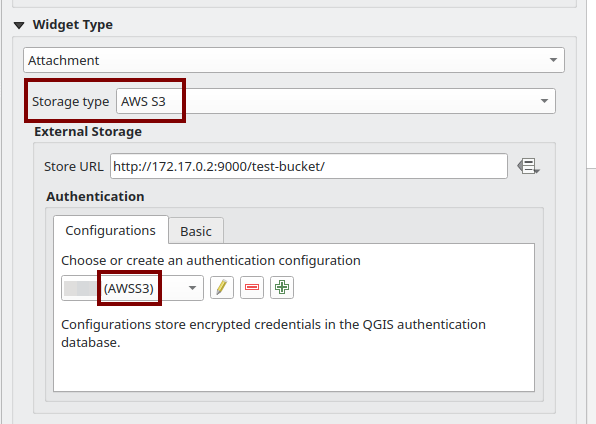

Amazon Simple Storage Service (AWS S3)Depuis QGIS 3.30 ‘s-Hertogenbosch, il est donc possible d’utiliser le type de stockage AWS S3 lors de la configuration du widget Pièce jointe, ainsi que le nouveau type d’authentification dédié :

Nouveau type d’authentification AWS S3

Nouveau type d’authentification AWS S3Notre article précédent présente un guide sur la configuration du formulaire de la couche géographique, afin de disposer d’une interface ergonomique permettant de visualiser les documents, et les envoyer sur le système de stockage directement via le formulaire de l’entité géographique.

Aperçu d’un fichier joint

Il suffit à présent de sélectionner AWS S3 comme type de stockage et d’authentification :

Nouveau type de stockage AWS S3

Stockage d’objet cloud compatibleMinIO est un système de stockage d’objet cloud compatible AWS S3, opensource, et facilement mis en place via Docker par exemple, pour stocker des documents et y accéder via QGIS.

A venirNous cherchons à améliorer cette fonctionnalité pour les prochaines version de QGIS : nous aimerions par exemple :

- ajouter de nouveaux types de stockage,

- améliorer le rendu des photos dans les fonds de carte,

- charger un projet directement à partir d’un stockage externe,

- etc ! on peut imaginer de nombreux usages complémentaires. N’hésitez pas à nous faire part de vos besoins

Si vous souhaitez contribuer ou simplement en savoir plus sur QGIS, n’hésitez pas à nous contacter à infos@oslandia.com et consulter notre proposition de support à QGIS.

-

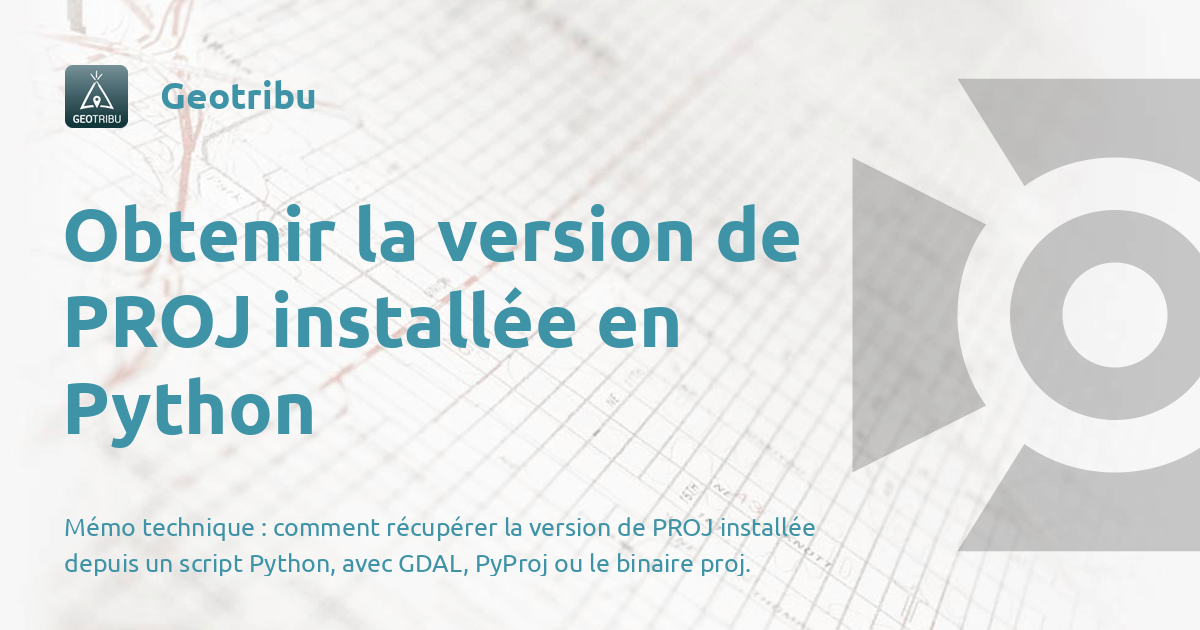

sur Que reste t’il de nos forêts ?

Publié: 4 September 2023, 7:45am CEST par Françoise Bahoken

Le changement climatique, la chaleur suffocante et maintenant, la soudaine tombée du froid. Est-ce que cela pourrait être dû à la baisse du couvert végétal ? Je demande…

A la faveur d’une collaboration en cours avec la FPAE, je suis sortie de ma zone de confort cet été pour essayer de prendre l’air, en m’intéressant aux forêts du Bassin du Congo ; le lien entre les très fortes températures et les épisodes de sécheresse que nous connaissons en Europe de l’ouest, le changement climatique et le lien avec le couvert végétal m’intéressant a priori.

N’étant pas familière avec ces sujets liés aux paysages végétaux, je suis entrée dans le sujet en commençant par me promener au cœur de bases de données librement accessibles en ligne – des bases de données que j’ai d’abord dû identifier. Je ne vais pas entrer dans trop de détail sur les données et les traitements réalisés, juste présenter quelques résultats cartographiques ci-après et probablement dans de prochains billets.Alors, pour commencer sur ce sujet des forêts, intéressons-nous aux forêts « encore intactes ». Cela tombe bien, un groupe de chercheurs à publié différents articles sur le sujet (voir notamment Potapov et al. 2017) qu’ils partagent sur www.intactforests.org, permettant alors de les caractériser et de les cartographier.

Un « paysage forestiers intact (PFI) est une étendue ininterrompue d’écosystèmes naturels à l’intérieur de la forêt actuelle, sans aucun signe d’activité humaine détectée à distance et suffisamment vaste pour que toute la biodiversité autochtone, y compris les populations viables d’espèces à large répétition, puisse être maintenue.

Pour les besoins d’évaluation globale, un PFI est défini [harmonisé au niveau mondial] comme un territoire formé d’écosystèmes forestiers et non forestiers très peu influencés par l’action anthropique, avec (i) une superficie d’au moins 500 km² (50 000 ha), (ii) une largeur minimale de 10 km (mesurée comme le diamètre d’un cercle englobant minimum le territoire concerné), et (iii) une largeur minimale de corridor/appendice de 2 km.

Les zones présentant des traces de certains types d’influence humaine sont considérées comme perturbées ou fragmentées et ne peuvent donc être incluses dans le PIF ».

Greenpeace, 2023 (trad. F. Bahoken),Une base de données disponible à plusieurs dates a également été construite sur ces PFI par un collectif de cartographes : l‘Impact Forest Landscape mapping team appartenant à Greenpeace, WRI, WCS, Département de Géographie de l’Univ. du Maryland, Transparent World et WWF (Russie),

J’ai été très très surprise de voir l’état de l’extension forestière en 2020 (dernière date disponible), particulièrement en Afrique et dans le bassin du Congo. La carte réalisée est littéralement dramatique. Jugez-en par vous mêmes.

Paysages forestiers « encore intacts » en 2020 dans le bassin du Congo

La forêt a t-elle été réduite rapidement ? Quelle était son emprise en 2000, par exemple ?

La forêt a t-elle été réduite rapidement ? Quelle était son emprise en 2000, par exemple ?Paysages forestiers intacts en 2000 dans le bassin du Congo

Ce n’est pas vraiment mieux qu’en 2000 et c’est le moins que l’on puisse dire. Pour mieux se rendre compte de l’étendue du désastre, j’ai superposé les deux cartes précédentes sur l’extension historique du couvert forestier

Ce n’est pas vraiment mieux qu’en 2000 et c’est le moins que l’on puisse dire. Pour mieux se rendre compte de l’étendue du désastre, j’ai superposé les deux cartes précédentes sur l’extension historique du couvert forestierÉvolution du couvert forestier dans le bassin du Congo entre 2011 et 2020

Références :

– Potapov, P., Hansen, M. C., Laestadius L., Turubanova S., Yaroshenko A., Thies C., Smith W., Zhuravleva I., Komarova A., Minnemeyer S., Esipova E. “The last frontiers of wilderness: Tracking loss of intact forest landscapes from 2000 to 2013” Science Advances, 2017; 3:e1600821

– Bases de données IFL mapping team Intact Forest Landscapes 2000/2013/2016/2020.

Géographe et cartographe, Chargée de recherches à l'IFSTTAR et membre-associée de l'UMR 8504 Géographie-Cités.

-

sur Les stations de ski fantômes : mythes et réalité d’un angle mort de la géographie du tourisme

Publié: 3 September 2023, 10:41pm CEST par r.a.

Par Pierre-Alexandre Metral

Doctorant en géographe – Université Grenoble AlpesPierre-Alexandre Metral qui réalise actuellement une thèse à l’UGA dans le cadre du Labex Innovations et Transitions Territoriales en Montagne (ITTEM) intitulée « La montagne désarmée, une analyse des trajectoires territoriales des stations de ski abandonnées » est intervenu le 18 avril 2023 à Chambéry dans le cadre d’un Café Géographie.

En guise de préambule, l’intervenant est revenu sur ce « phénomène des stations de ski fermées qui revient de plus en plus fréquemment dans les médias à travers le mythe de la station de ski fantôme ». Selon lui, le terme de « station de ski fantôme » est une dénomination bien particulière qui fait éminemment référence à une activité ancienne qui viendrait marquer l’histoire d’un territoire vécu et qui s’ancrerait comme un traumatisme qui ne passe pas.

Pour ce dernier, la station de ski fantôme renvoie à l’omniprésence des friches constituées d’un certain nombre de bâtiments et d’infrastructures délaissés, qui s’établissent comme des marqueurs de déprises sur les territoires, symbolisés par la rouille de ces installations. Des friches qu’il caractérise comme des espaces en « accès libre pour des pratiques contre culturelles ».

A partir de ce cadrage, Pierre-Alexandre Metral propose la problématique suivante pour ce Café géo : Est-ce que le mythe de la station de ski fantôme est représentatif de la mise à l’arrêt des domaines skiables français ?

1/ La « fin touristique » : normalité ou anomalie ?

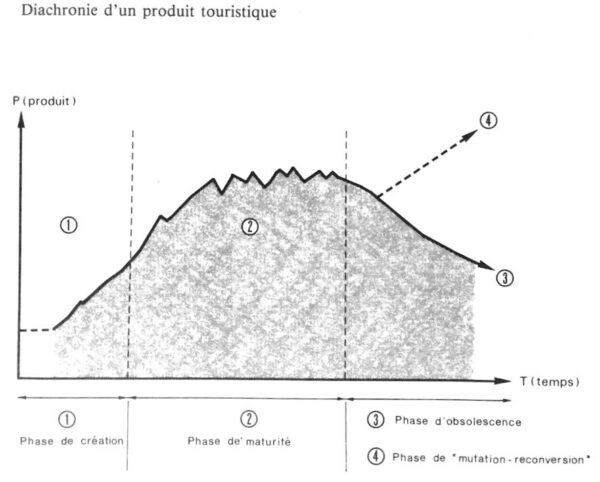

Pour l’intervenant, la vie de tout produit économique est marquée par l’idée de cycle de vie allant d’une introduction sur un marché jusqu’à son retrait. Pour transposer ce cycle de vie au cadre du tourisme, il évoque les travaux de Michel Chadefaud pour qui « le tourisme est un bien non durable […] marqué par une activation et une désactivation ». Pour illustrer ses propos, Pierre-Alexandre Metral projette la figure du cycle de vie d’un bien touristique.

Fig 1 : cycle de vie des produits touristiques – Michel Chadefaud 1988

A l’issue de la présentation de cette figure, le doctorant a proposé une série d’illustrations de proximité au public en présentant diverses « fins touristiques » du bassin chambérien. Il a notamment évoqué le cas de l’abandon du téléphérique du Mont Revard qui a fonctionné jusqu’à la fin de la décennie 1960 en lien avec l’activité thermale de la ville d’Aix-les-Bains.

Fig 2 : La gare de départ en 2022 – P-A Metral

2/ Pourquoi un domaine skiable ferme-t-il ?

En réponse à cette interrogation, Pierre-Alexandre Metral évoque des conditions d’exploitation de plus en plus vulnérables :

– Obsolescence des conditions d’exploitation liée au manque de neige

– Obsolescence face à la concurrence entre petits et grands domaines skiables

– Obsolescence du site d’implantation en raison d’accès routiers complexes

– Obsolescence de l’équipement avec des coûts d’exploitation et de maintenance de plus en plus onéreux corrélé au vieillissement des installations

– Obsolescence de certains modèles de développement en lien avec la disparition des classes de neige par exempleConcrètement, il lui est possible d’identifier 3 causes majeures de fermeture. En premier lieu et principalement, le motif économique avec des domaines skiables non rentables (ex : Pugmal dans les Pyrénées et ses 9,2 millions d’euros d’endettement). Vient ensuite l’épuisement des ressources humaines avec le départ en retraite d’exploitants privés sans transmission du capital touristique. Ce fut par exemple le cas dans le Jura où le petit téléski des Clochettes cessera son exploitation à la suite au décès de son fondateur et exploitant. Enfin, le cas des fermetures stratégiques liées à la mauvaise qualité des sites d’implantation et au redéploiement des activités sur de meilleures pentes. Pierre-Alexandre Metral évoque pour cela l’éphémère domaine de Supervallée à la Bresse (5 années d’exploitation), implanté sur un secteur pluvieux, qui deviendra suite à son déplacement en altitude la station de La Bresse, plus grand domaine skiable du massif vosgien.

Fig 3 : stade de neige du Puigmal en 2020, P-A Metral

3/ Quelle est la géo-histoire du phénomène de fermeture ?

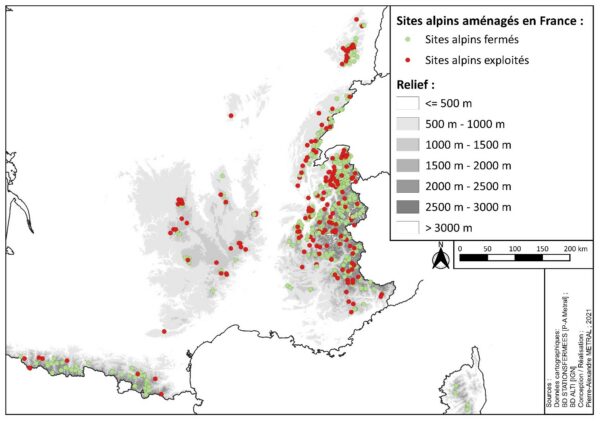

Cette troisième partie est l’occasion pour l’intervenant de mettre en avant l’absence d’inventaire des domaines fermés. Pour remédier à cet écueil, il s’est attaché dans le cadre de sa thèse à réaliser un inventaire exhaustif à partir de différentes sources qu’il présente au public : ouvrages et articles scientifiques anciens sur le ski, articles de presses locales, cartes topographiques, cartes postales et vues aériennes anciennes … Tout cela lui permettant « d’établir une base de données spatialisée des sites fermés en France. S’ensuit la présentation d’une animation cartographique qui présente les ouvertures et les fermetures de stations sur l’hexagone entre 1920 et 2022.

Fig 4 : Carte de localisation des sites français fermés et actuellement actifs en 2022 – BD STATIONSFERMEES, P-A Metral, 2022

A l’issue de cette animation Pierre-Alexandre Metral indique que ce phénomène de fermeture de stations touche tous les massifs montagneux en France (sauf la Corse) avec un épicentre dans les Alpes compte tenu de l’ampleur de ce dernier. Il présente également un taux de fermeture (rapport entre le nombre de sites fermés et actifs) tiré de ces travaux de thèse à hauteur de 31 %. Un taux apparaissant inégal en fonction des massifs de montagne : la moyenne montagne apparaissant en moyenne bien plus marquée par le phénomène de fermeture. Il termine son analyse statistique en cherchant à recontextualiser l’ampleur des fermetures en France : « les petits domaines skiables de basse ou moyenne montagne apparaissent donc les plus fragiles. Ils représentent au total 350 kilomètres de pistes en cumulé, soit une perte sèche de 3,34 % du domaine skiable français actuel ».

4/ Les stations fantômes sont-elles réellement des stations ?

Cette nouvelle interrogation proposée par Pierre-Alexandre Metral, lui permet de faire remarquer qu’un grand nombre de « stations fantômes » sont en réalité : des centres de ski (135/186) , soit des sites mono-spécialisés dans la pratique du ski, parfois rudimentaires, ne comptant uniquement les équipements essentiels à la pratique (parking + remontée mécanique) des stades de neige (43/186) auquel il faut ajouter la fonction de services touristiques in situ (location de ski, petite restauration…) et enfin de toutes petites stations touristiques (8/186) qui comptaient quelques lits marchands pour une offre de séjours. Il conclut ce quatrième temps en indiquant qu’en réalité les sites apparentés à de « petites stations touristiques » sont encore peu concernés par les mises à l’arrêt de leurs domaines skiables. Pour autant, la dynamique de ces 20 dernières années expose que ces sites tendent de plus en plus à être touchés par l’arrêt de l’offre de ski.

5/ Une incarnation de la station fantôme : la friche touristique

Ce cinquième temps proposé par le doctorant lui permet d’évoquer les pistes possibles de reconversion des appareils de remontées mécaniques définitivement mis à l’arrêt. Néanmoins, il avertit d’emblée le public que ces reconversions sont pour beaucoup illusoires : les réactivations des domaines skiables sont risquées, la mono-spécialisation des équipements fait que le réemploi du matériel pour des loisirs d’été est extrêmement rare, que le marché de l’occasion est devenu une niche impénétrable faute à un matériel vieillissant et totalement obsolète.

Toujours en lien avec cette question de la friche touristique, l’intervenant aborde la question du démontage des appareils dont le coût est très élevé (entre 5000 et 20 000 € pour un téléski), avec bien souvent à la sortie des installations laissées en place et qui se détériorent faute de financements et parfois même à l’oubli des appareils le temps passant. Le « bilan comptable » du délaissement des appareils des sites fermés français est ainsi présenté : 92 appareils en friche en France en 2023 répartis en 3 catégories : 87 téléskis, 3 télésièges, 2 téléphériques. Si la majeure partie des appareils délaissés sont issus de fermetures récentes et qu’ils pourront éventuellement être réactivés, 30 appareils ont tout de même été abandonnés il y a plus de 20 ans ; les plus anciens depuis 1951.

6/ Vers la fin des friches touristiques ?

Cet avant-dernier point permet à Pierre-Alexandre Metral de revenir sur les initiatives nouvelles visant à accompagner le démontage et contenir le phénomène de délaissement. Au premier chef, les dispositions de la Loi Montagne II (2016) fixant notamment un échéancier dans le temps pour aboutir à un démontage. Le doctorant dans une posture plus critique pointe cependant ses limites, notamment la non-rétroactivité de ces dispositions faisant que les appareils d’ores et déjà délaissés ne sont pas concernés.

Par la suite, les corps intermédiaires engagés dans le démantèlement sont présentés. D’une part, Mountain Wilderness, l’acteur historique du démontage des installations obsolètes qui depuis 2001) a opéré par la voie bénévole au retrait d’une vingtaine d’appareils. D’autre part, la chambre professionnelle des exploitants de domaines skiables (Domaines Skiables de France) est engagée à l’organisation du démontage de 3 appareils délaissés par ans avec le concours d’opérateurs régionaux encore actifs qui vont réaliser les travaux dans une logique de solidarité.

Fig 5a et 5b : Le démantèlement des téléskis de Sainte-Eulalie (07) – P-A Metral, 2020

7/ La reconversion des anciennes stations de ski

Ce dernier temps proposé par l’intervenant est l’occasion de dresser des perspectives en matière de revivification des sites après la fermeture des domaines alpins. Il identifie ainsi un ensemble de trajectoires : le retour à l’état pré-touristique (alpages, forêt) et des activités agro-sylvo-pastorales. La reconversion des sites en bases de loisirs de montagne avec le développement d’activités organisées sur la saison d’été. Le réinvestissement des logements touristiques pour de l’habitat permanent, transformant ainsi les anciennes stations en hameaux de montagne. Enfin, Pierre-Alexandre Metral ne minore pas les pratiques récréatives réalisées en autonomie (ski de randonnée, vtt…), parfois aussi furtives, dissidentes et contre-culturelles (free party, street ski, street art…) qui dans une logique de réappropriation, redonnent de la vie et du sens aux anciens sites abandonnés.

Conclusion :

Pour Pierre-Alexandre Metral « le phénomène de fermeture est important en effectif avec 186 sites concernés », néanmoins la plupart sont de tailles insignifiantes, bien loin de l’image de la station fantôme évoquée en introduction. Ce mythe s’ancre en réalité sur « des cas sensationnels, très visuels et au final peu représentatifs du paysage réel des fermetures françaises ». Ces mises à l’arrêt illustrent, « plus que la fin du ski », la disparition d’un modèle de développement spécifique aujourd’hui presque disparu : les centres de ski. La carte du ski français se voit progressivement amputée des sites « de proximité », dédiés à l’apprentissage ; un ski de village, résolument social, où les tarifs pratiqués étaient aux antipodes des grands domaines alpins qui font la renommée du ski français.

Il termine ce café géo par ces mots « la station fantôme c’est le temps de l’incertitude, l’enjeu demain c’est de pouvoir anticiper en amont des fermetures la question de la remise en état des sites et leurs éventuelles reconversions ».

Par Yannis NACEF

Professeur agrégé de Géographie

Doctorant en Géographie – UMR 5204 EDYTEM – Université Savoie Mont Blanc – CNRS -

sur L’épicerie du monde. La mondialisation par les produits alimentaires du XVIIIe siècle à nos jours

Publié: 3 September 2023, 7:30pm CEST par r.a.

Pierre Singaravélou et Sylvain Venayre ont convié à l’écriture « d’une histoire du monde par les produits alimentaires » de très nombreux auteurs. Pas moins de 400 pages qui se dévorent à pleines dents. Vous ne serez pas surpris que le chapitre sur le vin soit confié à Jean-Robert Pitte et que Christian Grataloup vous invite à la consommation du thé et à la dégustation de la baguette de pain tandis que Philippe Pelletier vous propose sushi et saké. Emmanuelle Perez Tisserant offre le chili con carne et le guacamole. Sylvain Venayre nous sert des charcuteries et du ketchup, Pierre Singaravélou opte pour le whisky et le rhum. Une centaine de produits sont proposés, dans un inventaire à la Prévert, où chacun pourra tout à la fois s’instruire gaiement et se mettre l’eau à la bouche. A vous tous, gourmands ou gourmets, ils offrent un savoureux voyage dans la grande « épicerie du monde ». Vous terminerez avec une coupe de champagne proposée par Stéphane Le Bras.

L’épicerie, magasin consacré aux produits alimentaires, se généralise au milieu du XVIIIe siècle. Mais le commerce des épices est bien plus ancien. En Angleterre la guilde des poivriers date de 1180 et l’épicerie est « magasin d’épices » avant de devenir boutique de produits alimentaires. La Révolution industrielle et la révolution des transports vont mondialiser les désirs identitaires, dont ceux liés à la gastronomie. Les expositions universelles apporteront à leur tour une mondialisation des offres. La baguette française, le roquefort et bien sûr les vins français doivent paraître sur les grandes tables, au XXe siècle.

Qui ne connaît à présent le Christmas pudding, emblème de l’empire britannique, la pizza italienne, le saké japonais, la féta grecque ou le ceviche péruvien ! Mais êtes-vous sûrs de connaître la patrie du couscous, du houmous, de la vodka ?L‘accès aux produits alimentaires est vital pour les populations. Des guerres peuvent éclater ici ou là. Les historiens ont noté la destruction du thé britannique par les colons de Boston en 1773. Dans un contexte différent, la guerre entre l’Ukraine et la Russie (ou plus exactement l’invasion de l’Ukraine), enclenchée en février 2022, comporte un volet alimentaire : celui des céréales exportées par l’Ukraine mais à présent retenues par les navires russes. Cela va provoquer des crises alimentaires graves, deux milliards de personnes restant frappés de malnutrition.

Les pratiques sociétales évoluent. Il n’y a pas si longtemps on pouvait rester plusieurs heures à table lors des repas dominicaux ; il y avait l’heure du thé en Angleterre, l’heure du raki en Turquie. Les femmes au foyer préparaient « avec amour » des plats appétissants. Mais la généralisation du travail féminin a conduit à la consommation de boîtes de conserves puis de plats surgelés. La publicité s’est chargée de vous faire acheter du Coca Cola dès 1916 !

Au début du XXIe siècle, la restauration doit être rapide, autour d’une baraque à frites ou à hot-dogs, ou à hamburgers. Le fish and chips eut son heure de gloire, mais s’affirmer végétarien ou vegan, c’est « être tendance » dans les années 2020.Consommer tel ou tel produit pouvait être recommandé par le corps médical. Ainsi le whisky et le vin de Porto facilitaient la digestion ou bien soignaient la goutte. Mais aujourd’hui l’OMS nous met en garde en listant des produits cancérigènes ou favorisant l’obésité… On ne sait plus à quel saint se vouer… Rassurez-vous, les Appellations d’Origine Contrôlée (AOC) vont nous permettre non seulement de choisir les meilleurs produits mais aussi ceux qui bénéficient d’un contrôle sanitaire.

Dans l’introduction de l’ouvrage, on peut lire une citation de Roland Barthes qui déclarait que la nourriture suscitait trois sortes de plaisir : celui de la convivialité, par le fait de partager le même plat ; celui de la réminiscence, qui nous fait retrouver les goûts de notre enfance ; et celui du nouveau, de l’insolite qui nous attire vers celles et ceux que nous ne connaissons pas encore.

Un savoureux voyage à ne rater sous aucun prétexte.Maryse Verfaillie, août 2023

-

sur Cartes et données sur les tremblements de terre au Japon depuis 1923

Publié: 3 September 2023, 4:50pm CEST

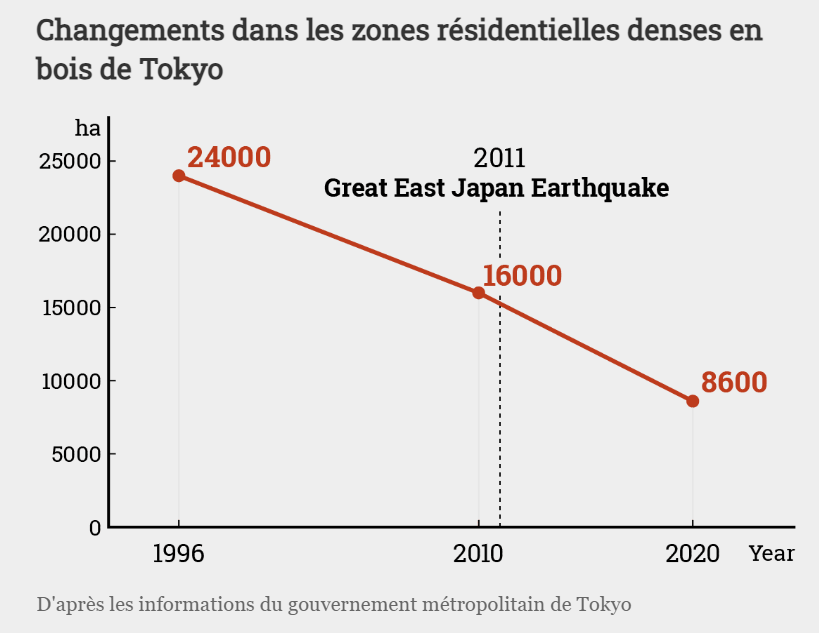

A l'occasion du 100e anniversaire du grand tremblement de terre du Kant?, le quotidien japonais Nikkei propose une reconstitution cartographique de la façon dont près de la moitié de la ville de Tokyo a été détruite le 1er septembre 1923. Le séisme qui a touché le centre de la capitale avait une magnitude de 7,9. Frappant vers midi alors que les familles préparaient leurs repas, il a provoqué de nombreux incendies hatisés par des vents violents, particulièrement destructeurs du fait de constructions majoritairement en bois.

« Comment les incendies ont ravagé Tokyo pendant 46 heures » (une storymap proposée par Nikkei)

Tokyo a brûlé pendant 46 heures après le tremblement de terre. À l’époque, la superficie de la ville s’élevait à 79,4 kilomètres carrés. Sur ce total, les incendies ont brûlé 34,7 km², soit plus de 40 % du territoire urbain. À la suite du séisme massif de 2011 dans l'est du Japon, le gouvernement métropolitain de Tokyo a établi un « système de zones spéciales ignifuges » et a encouragé la démolition ou la reconstruction en dur de structures en bois vieillissantes.

Comparaison de trois séismes majeurs au Japon (supérieurs à une magnitude de 7)

Si on compare sur un siècle trois séismes supérieurs à une magnitude de 7, les dégâts humains et matériels ont globalement diminué au Japon. Mais les coûts financiers ont explosé du fait de l'essor urbain et de l'augmentation du nombre et de la valeur des biens. Le gouvernement japonais estime à environ 70 % les chances qu'un séisme de magnitude 7 se produise à nouveau d'ici 30 ans.

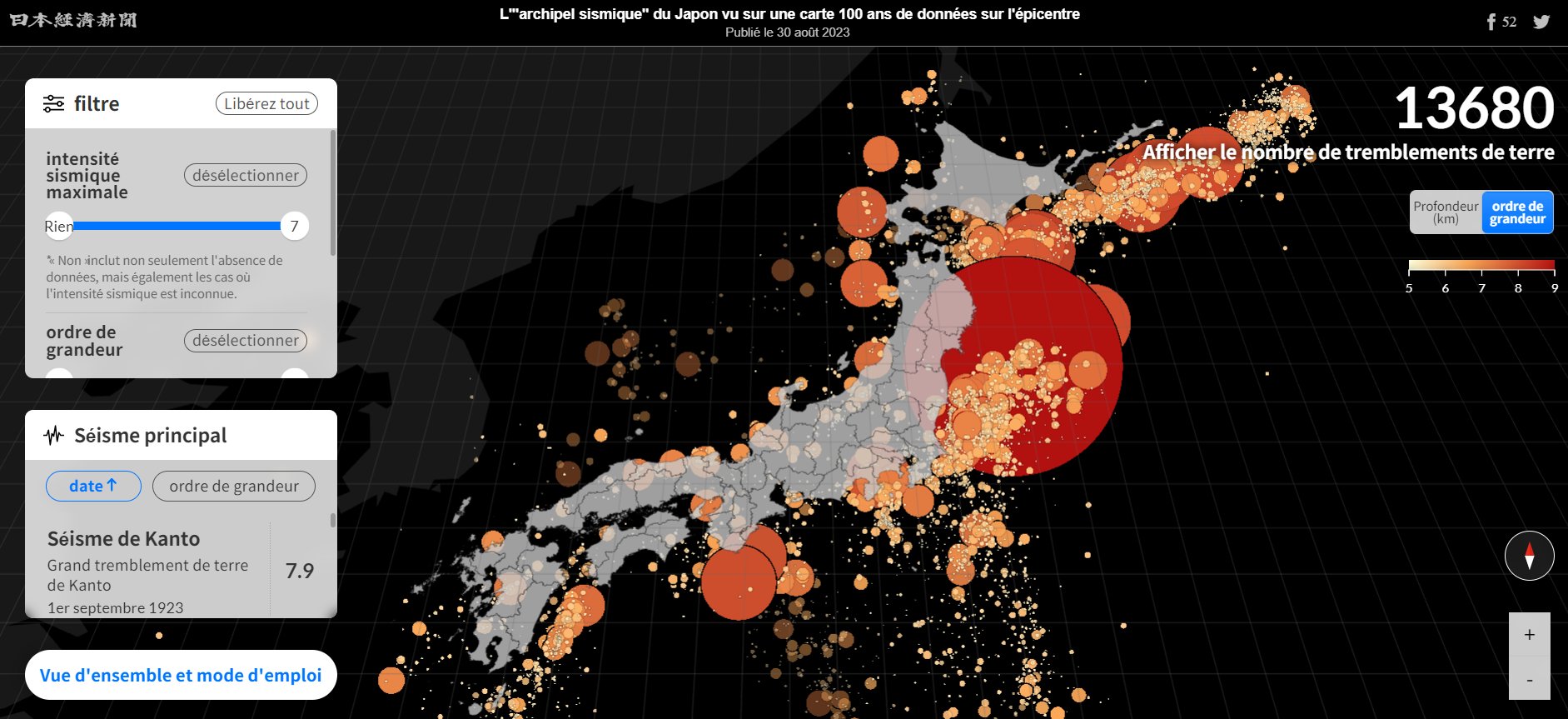

Le journal économique Nikkei a également commémoré le 100ème anniversaire du grand tremblement de terre de Kant? en créant une carte interactive qui montre l'épicentre et l'intensité des 13 680 tremblements de terre (supérieurs à une magnitude 5) qui ont frappé le Japon depuis 1923.

Tremblements de terre ayant eu lieu dans l'archipel japonais depuis 1923 (source : Nikkei)

L'épicentre de chaque séisme est représenté par une cercle proportionnel sur la carte. Plus le tremblement de terre est important, plus le cercle est gros. La couleur est modifiée en fonction de la magnitude (couleurs chaudes) et de la profondeur de l'épicentre (couleurs froides) : plus chacune devient grande (plus profonde), plus la couleur devient sombre.Les données utilisées pour réaliser cette carte sont issues du rapport mensuel sur les tremblements de terre (1er septembre 1923 - mars 2022) et la liste des lieux sismiques (avril 2022 - 31 juillet 2023) de l'Agence météorologique du Japon. Les données d'intensité sismique proviennent du rapport mensuel des tremblements de terre et de la base de données sur l’intensité sismique. Les valeurs de la liste des épicentres du séisme et de la base de données d'intensité sismique sont des valeurs provisoires. L'emplacement des limites de plaques tectoniques est basé sur les données publiées par l'Institut de recherche sur les tremblements de terre de l'Université de Tokyo. Les cartes estimant la probabilité de nouvaux tremblements de terre sont accessibles sur le site du Centre de promotion de la recherche sur les tremeblements de terre.

Articles connexes

Cartes-posters sur les tsunamis, tremblements de terre et éruptions volcaniques dans le monde (NOOA, 2022)

Un nouveau modèle de plaques tectoniques pour actualiser notre compréhension de l'architecture de la Terre

Carte-poster des tremblements de terre dans le monde de 1900 à 2018 (USGS)

Cartes et données sur les séismes en Turquie et en Syrie (février 2023)

Cartes et données sur le séisme au Maroc (septembre 2023)

Analyser et discuter les cartes de risques : exemple à partir de l'Indice mondial des risques climatiques

Une anamorphose originale montrant l'exposition accrue des populations au risque volcanique

Les éruptions volcaniques et les tremblements de terre dans le monde depuis 1960

L'incendie de l'usine Lubrizol de Rouen et la cartographie des sites Seveso en France

Comprendre la mégapole japonaise en utilisant le site "To?kyo?, portraits et fictions"

-

sur HR TIR DA IRL (High Resolution Thermal Infra-Red Directional Anisotropy In Real Life)

Publié: 1 September 2023, 12:06pm CEST par Julien Michel

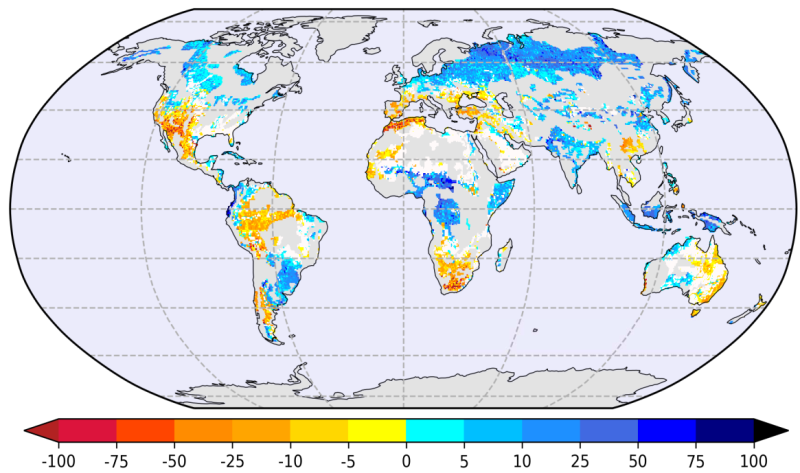

Dans le cadre de la préparation de la mission Trishna, une question importante concerne la nécessité de corriger les effets directionnels dans les images, ainsi que la méthode à appliquer. Certains d’entre vous sont sans doute familiers de l’effet dit de « hotspot » dans le domaine réflectif, qui a été bien illustré sur notre blog. Dans le domaine de l’Infra-Rouge Thermique, les effets directionnels ne sont pas provoqués par une réflexion directe de la lumière du soleil, mais plutôt par un changement de proportion entre des éléments à l’ombre – donc plus froids – et des éléments au soleil – donc plus chauds – au sein du pixel. Un autre effet, connu sous le nom de gap fraction, est également relié au changement de proportion entre la fraction visible de sol nu et celle de végétation, qui ont des émissivités ou des températures bien différentes. Ces proportions changent continuellement avec les angles de vue du satellite, et quand ces angles sont parfaitement alignés avec les angles solaires, les éléments à l’ombre deviennent invisibles dans le pixel, ce qui cause une température observée plus élevée. Étant donné le champ de vue de +/-34° prévu pour Trishna, ce phénomène se produira régulièrement en fonction de la saison et de la localisation sur le globe.

Il est important de noter que la température de surface (LST pour Land Surface Temperature) n’est pas stable dans le temps comme peut l’être la réflectance de surface (SR pour Surface Réflectance). En effet les facteurs d’évolution principaux de la température de surface sont la météo et le cycle quotidien du soleil. C’est pourquoi, si les effets directionnels dans le domaine Infra-Rouge sont bien modélisés dans des codes de transfert radiatif comme SCOPE ou DART, et parfois observés lors des campagnes terrains instrumentés, ils sont plutôt difficile à observer dans les données satellites réelles, en particulier dans la gamme des Hautes Résolutions (en dessous de 100 mètres). Au CESBIO, nous sommes parti à la chasse (ou plus exactement à la pêche) dans le grand lac des données publiques de télédétection, et – coup de bol – nous avons eu une touche. Vous pouvez trouver notre récit complet ici (ou dans le preprint sur HAL):

Julien Michel, Olivier Hagolle, Simon J. Hook, Jean-Louis Roujean, Philippe Gamet, Quantifying Thermal Infra-Red directional anisotropy using Master and Landsat-8 simultaneous acquisitions, Remote Sensing of Environment, Volume 297, 2023, 113765, ISSN 0034-4257, [https:]] .

En cherchant des acquisitions quasi-simultanées entre Landsat-8 et le capteur aéroporté avec un grand champ de vue MASTER de la NASA (avec l’aide précieuse du JPL), nous avons pu observer la LST quasiment au même moment (à moins de 15 minutes d’intervalle), acquise sous deux angles de vue différents pour 9 scènes en Californie, dont 3 sont proches des conditions de hotspot, comme montré dans la figure ci-dessous (tracks (2), (8) et (12)) :

Différence de température entre MASTER et Landsat-8, en fonction des angles de visée azimut et zénith de MASTER. La couleur rouge (resp. bleue) signifie que MASTER est plus chaud (resp. plus froid) que Landsat-8. La position du soleil est marquée par une étoile orange.

Différence de température entre MASTER et Landsat-8, en fonction des angles de visée azimut et zénith de MASTER. La couleur rouge (resp. bleue) signifie que MASTER est plus chaud (resp. plus froid) que Landsat-8. La position du soleil est marquée par une étoile orange.

Nous avons observé des différences de LST jusqu’à 4.7K à l’intérieur du champ de vue prévu pur Trishna. En utilisant ces données pour estimer les paramètres de modèles de correction issus de la littérature, nous avons pu ramener cette erreur sous la barre des 2K dans tout les cas, même si nos expériences n’ont pas permis d’identifier le modèle le plus performant. La figure ci-dessous montre à quel point les différents modèles collent aux effets directionnels observés, quand leurs paramètres sont estimés à partir de toutes les observations.

Estimation aux moindres-carrés des paramètres de cinq modèles directionnels à partir des différences de température observées. L’axe vertical représente le pourcentage de variation de la température entre Landsat (considéré comme Nadir) et MASTER. Dans cette figure, les paramètres conjointement sur l’ensemble des données. Les lignes verticales en pointillés bleus représentent le champ de vue de Trishna.

Estimation aux moindres-carrés des paramètres de cinq modèles directionnels à partir des différences de température observées. L’axe vertical représente le pourcentage de variation de la température entre Landsat (considéré comme Nadir) et MASTER. Dans cette figure, les paramètres conjointement sur l’ensemble des données. Les lignes verticales en pointillés bleus représentent le champ de vue de Trishna.

Un autre constat intéressant concerne la sensibilité des effets directionnels à l’occupation du sol et au stades de croissance de la végétation. En théorie, les paramètres des modèles devraient dépendre de ces facteurs. En effet, le mélange entre parties à l’ombre et au soleil, ainsi qu’entre végétation et sol nu, devrait changer de manière plus importante pour les couverts végétaux intermédiaires. Cependant, nous avons essayé de corréler les différences de températures observées entre MASTER et Landsat-8 avec une combinaison des cartes d’occupation du sol fournies par Copernicus (Copernicus Global Land Service Maps) et du NDVI fourni par Landsat-8. Nous n’avons pas observé de changement significatif des tendances entre les différentes classes et stades végétatifs, comme le montre la figure ci-dessous. Ceci ne veut pas dire que l’occupation du sol et le stade de croissance de la végétation n’est pas important pour la correction des effets directionnels, mais plutôt que les sources de données disponibles pour ces variables sont sans doute trop imprécises pour être utilisées de cette manière.

Moyenne ± écart-type des différences de température entre MASTER et Landsat-8, en fonction de l’angle de visée zénithal de MASTER, pour les classes principales ( >15% ) de chaque site.

Moyenne ± écart-type des différences de température entre MASTER et Landsat-8, en fonction de l’angle de visée zénithal de MASTER, pour les classes principales ( >15% ) de chaque site.

Même s’il reste beaucoup à faire pour intégrer la correction des effets directionnels dans les segments sols à venir, cette étude montre que sur un ensemble limité d’observations réelles (en Californie), les modèles paramétriques de la littérature avec un paramétrage statique peuvent être utilisés pour diminuer l’impact de ces effets. Cette étude plaide également pour des campagnes aériennes plus importantes dédiées à ce sujet (hors de la Californie), avec des survols simultanées de Landsat-8, afin de pouvoir qualifié et calibrer ces modèles avec un panel plus large de paysages et de conditions d’observations.

-

sur HR TIR DA IRL (High Resolution Thermal Infra-Red Directional Anisotropy In Real Life)

Publié: 1 September 2023, 12:04pm CEST par Julien Michel

=>

=>

In the frame of the preparation of the Trishna mission, one important question is : do we have to correct for directional effects, and how should we do it ? Some of you may be familiar with the so-called hotspot effect in the reflective domain, which is well illustrated on our blog. Well in Thermal Infra-Red domain, directional effects are not caused by direct reflection of the sun light, but rather by the change of proportion between shaded, cooler elements and sunlit, hotter elements within the pixel. Another effect, called gap fraction, also relates to a change in proportion between vegetation and ground seen in the pixel, since they have very different emissivities. Those proportions continuously change with the satellite viewing angles, and when the viewing angles of the satellite perfectly align with the sun angles, the shaded elements become invisible in the pixel, resulting in a higher observed temperature. Given the wide field of +/-34° of Trishna sensor, this will be occuring quite often depending on the season and the location.

It is noteworthy that the Land Surface Temperature (LST) is not as stable in time as Land Surface Reflectance (SR), since temperature is mainly driven by meteorological forcing and daily sun cycle. Therefore, if directional effects in TIR domain are well modeled by radiative transfer codes such as SCOPE or DART, and sometimes captured by instrumented field studies, they are quite hard to observe in real satellite data, especially in the High Resolution range (below 100 meter). At CESBIO, we went on a hunt (well actually, more a fishing party) in the wide lake of publicily available remote sensing data, and – luckily – we got a catch. You can read the full story here (or the preprint on HAL):

Julien Michel, Olivier Hagolle, Simon J. Hook, Jean-Louis Roujean, Philippe Gamet, Quantifying Thermal Infra-Red directional anisotropy using Master and Landsat-8 simultaneous acquisitions, Remote Sensing of Environment, Volume 297, 2023, 113765, ISSN 0034-4257, [https:]

By leveraging the MASTER airborne wide field of view sensor from NASA (with the kind support from JPL) and Landsat-8 near simultaneous acquisitions, we were able to observe the LST almost simultaneoulsy (less than 15 minutes appart) acquired under different viewing angles, for 9 scenes in California, 3 of which are close to hotspot conditions, as can be seen in the figure below (tracks (2), (8) and (12)).

Differences in temperature between MASTER and Landsat-8, depending on MASTER azimuth and zenith viewing angles. Red (resp. blue) mean MASTER is hotter (resp. cooler) than Landsat-8. The sun position marked by an orange star.

Differences in temperature between MASTER and Landsat-8, depending on MASTER azimuth and zenith viewing angles. Red (resp. blue) mean MASTER is hotter (resp. cooler) than Landsat-8. The sun position marked by an orange star.

We observed a LST difference of up to 4.7K within the future viewing angle of Trishna. By fitting parametric models from the litterature, we were able to reduce this error below 2K in all cases, though our experiments did not allow to determine which model should be preferabily used. The figure below shows how well the different models fitted the directional effects, when fitted on all tracks at once.

Least-Square fitting of five TIR directional models on SBT differences. Vertical axis represent the percentage of variation of SBT between Landsat-8 (considered as Nadir) and MASTER. In this figure, each model is jointly fitted on all tracks.Blue dashed vertical lines indicate Trishna field of view.

Least-Square fitting of five TIR directional models on SBT differences. Vertical axis represent the percentage of variation of SBT between Landsat-8 (considered as Nadir) and MASTER. In this figure, each model is jointly fitted on all tracks.Blue dashed vertical lines indicate Trishna field of view.

Another interesting outcome of this study is the sensitivity to land cover and vegetation growing stage. In theory, model parameters should be driven by those factors. Indeed, the mix between shadow/sunlit and vegetation/bare soil should change more dramatically with intermediate vegetation covers. However, when we tried to relate the difference between MASTER and Landsat-8 observed temperature to a combination between a landcover class from Copernicus (Global Land Service maps) and NDVI stratas from Landsat-8 for the growing stage, we did not observe significant trends: all classes behave alike, as shown in the figure below. From this experiment we should not conclude that land-cover and vegetation growth stage is not important for directional effects mitigation, but rather that current available sources of land-cover are probably too coarse and imprecise to be used for the correction of directional effects.

Mean ± standard-deviation of unbiased SBT difference with repect to MASTER signed view zenith angle for the major land-cover classes (> 15%) of each track.

Mean ± standard-deviation of unbiased SBT difference with repect to MASTER signed view zenith angle for the major land-cover classes (> 15%) of each track.

While there is still a lot to do to get operational directional effects corrections in up-coming ground segments, this study shows that on a limited set of real life scenes (from California), parametric models from the litterature with a fixed set of parameter can be used to mitigate the impact of those effects. It also advocates for larger dedicated airborne campaigns (outside of California) with simulatenous flight with Landsat-8, so as to qualify and calibrate those models on a wider range of landscape and conditions.

-

sur Administrateur systèmes

Publié: 31 August 2023, 2:17pm CEST par Lise Benazeth

Contrat : CDI

Lieu : Nantes

-

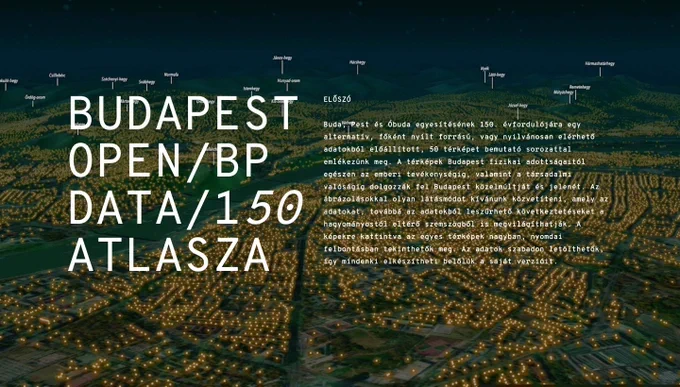

sur Rechercher du texte sur les cartes de la collection David Rumsey

Publié: 31 August 2023, 12:42pm CEST

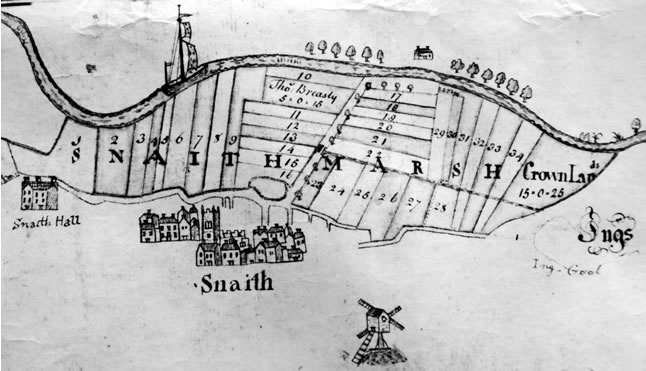

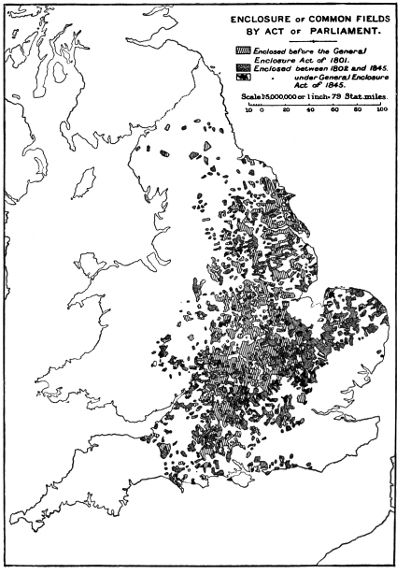

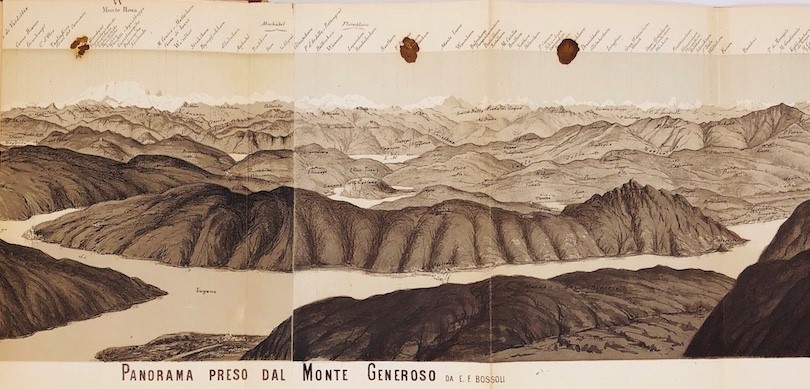

Mis en place en août 2023, le nouvel outil Text-on-Maps permet de rechercher du texte par reconnaissance de caractères sur les cartes de la collection David Rumsey (au total 100 millions de mots indexés sur 57 000 cartes). Jusque là, on ne pouvait interroger que les données et métadonnées du catalogue. Désormais il est possible de chercher des cartes en fonction du texte qu'elles contiennent. Qu'il s'agisse des noms de lieux, de rues, de monuments, de rivières, etc..., les cartes anciennes constituent une source inestimable d'informations historiques et géographiques. La reconnaissance automatique de caractères (OCR) permet d'identifier et d'extraire ces éléments, donnant la possibilité d'étudier et d'analyser l'évolution des paysages, de l'occupation du sol, de l'urbanisme ou des changements géographiques. Une fois le mot saisi et les résultats affichés, il suffit de cliquer sur les étiquettes pour accéder aux cartes correspondantes.

Résultats de recherche avec le mot "Reunion" (507 occurrences) - Source : David Rumsey Collection

Il n'est pour l'instant pas possible de rechercher des mots dans des alphabets non latins, mais l'équipe du site travaille à améliorer les performances de l'outil de machine learning mapKurator afin qu'il soit progressivement utilisable dans toutes les langues. Les recherches ne sont pas sensibles à la casse et ne peuvent pas non plus accepter les expressions. Les recherches multi-mots sont toutefois possibles lorsque les mots adjacents se trouvent à une distance de moins de deux caractères par rapport aux deux points les plus éloignés du polygone de délimitation. On peut par exemple repérer les cartes qui utilisent les deux noms "Réunion" et "Bourbon". L'ordre des mots, les différences de graphie et le fait qu'ils soient indiqués (ou non) entre parenthèses apportent des informations intéressantes (pour savoir par exemple combien de temps le nom de Bourbon a été conservé sur les cartes).

Résultats de recherche avec les mots "Reunion" et "Bourbon" (507 occurrences) - Source : David Rumsey Collection

La qualité des résultats varie en fonction des couleurs du fond, des polices de caractères, de la technique d'impression, de la langue, de l'état de conservation de ces cartes anciennes. La graphie d'un même nom a pu également évoluer. Il peut être intéressant par exemple de chercher comment on écrivait et représentait l'Équateur. On peut utiliser Text-on-Maps aussi pour trouver des points d'intérêt, par exemple une mine d'or, un phare, un moulin, une église, un bureau de poste, etc...

Résultats de recherche avec le mot "Equator" (507 occurrences) - Source : David Rumsey Collection

Les utilisateurs de la collection David Rumsey sont invités à corriger les erreurs éventuelles en proposant une meilleure transcription et/ou à un cadre de délimitation plus précis. Il arrive que certaines cartes portent des noms légendaires ou renvoient à des lieux imaginaires, comme par exemple les fameux Monts de Kong en Afrique... qui n'ont j'amais existé ! On peut chercher des lieux mythiques, par exemple l'Eldorado, l'Atlantide, l'Enfer, le Paradis, etc...

Résultats de recherche avec le mot "Kong" (3 133 occurrences) - source : David Rumsey Collection

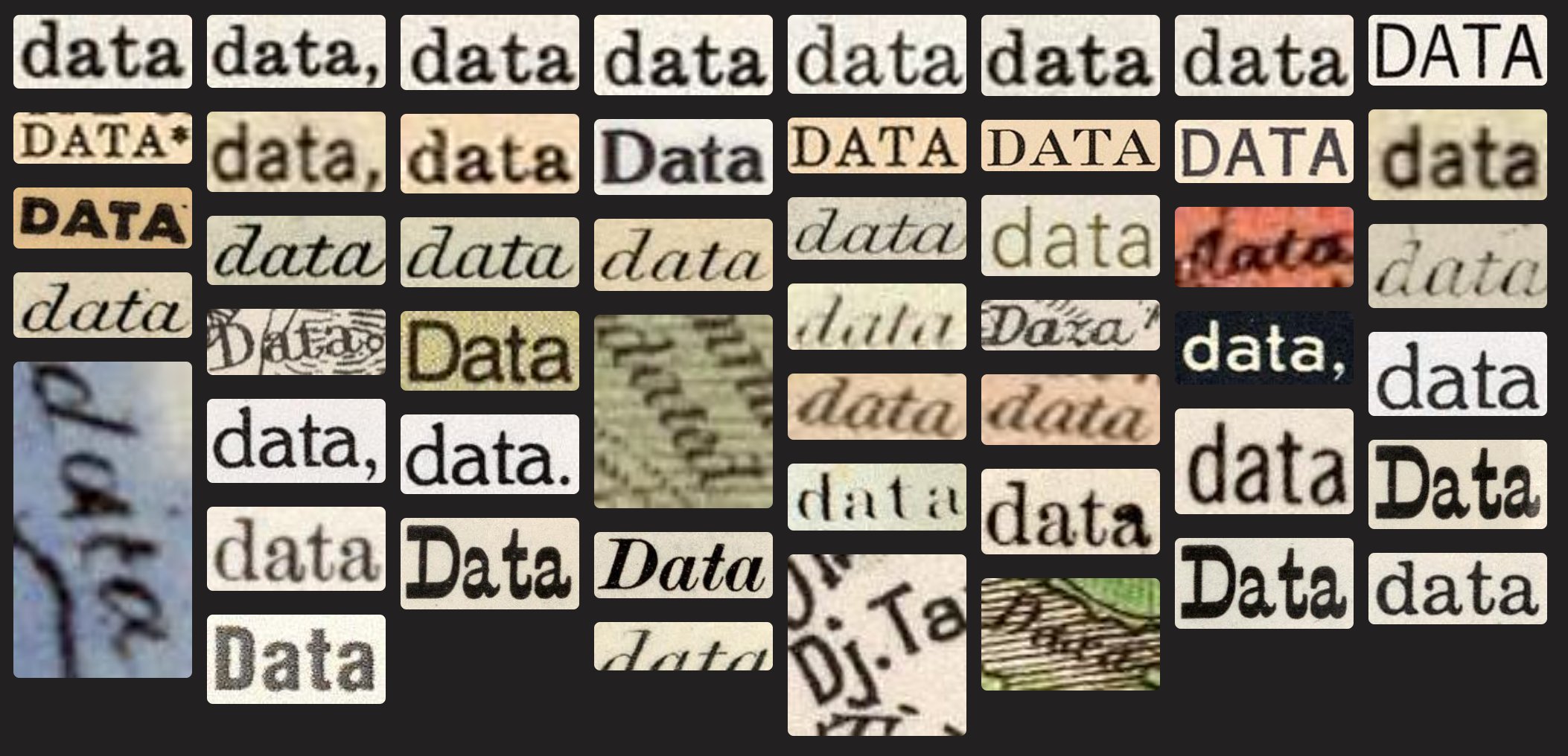

Il est possible retrouver des cartogrammes et des graphiques contenus dans des Atlas anciens en saisissant par exemple le terme "data"

Résultats de recherche avec le mot "data" (3 133 occurrences) - source : David Rumsey Collection

Si vous souhaitez affiner les résultats de votre requête avec des filtres basés sur les données du catalogue, vous devez utiliser les fonctionnalités de la recherche avancée. Consultez l'aide détaillée de Text-on-Maps pour obtenir des descriptions complètes sur l'utilisation de cette nouvelle fonctionnalité intéressante.

MapKurator est un outil de machine learning développé par le Knowledge Computing Lab de l'Université du Minnesota pour traiter un grand nombre d'images de cartes historiques numérisées. Les sorties incluent les étiquettes de texte, les polygones de délimitation des étiquettes, les étiquettes après correction post-OCR et un identifiant de géo-entité OpenStreetMap.

The mapKurator System : A Complete Pipeline for Extracting and Linking Text from Historical Maps :

[https:]]Pour accéder à mapKurator sur Github :

[https:]]

Pour compléterGoogle Lens, intégré au moteur Google Image, permet également de reconnaître des noms sur une image ou sur une carte, en important le fichier ou en saisissant simplement son URL. Ce qui permet de récupérer de nombreux toponymes et éventuellement de les traduire en français.

Détection automatique de texte sur des images ou des cartes avec Google Lens

Qu'il s'agisse du moteur interne du site David Rumsey ou du moteur de recherche sur Internet Google Lens, ces outils de reconnaissance de caractères à partir d'images numérisées viennent considérablement enrichir les possibilités de recherche, de sélection et d'analyse en utilisant les nomenclatures que l'on peut trouver sur les cartes. La carte, on l'oublie souvent, c'est du texte aussi bien que de l'image !

« De la reconnaissance de caractères au panoptisme historique en toponymie et cartographie ? Questions et premiers enseignements d’une évolution qui vient » (Géographies linguistiques).

Interview de D. Rumsey

— Sylvain Genevois (@mirbole01) September 18, 2023

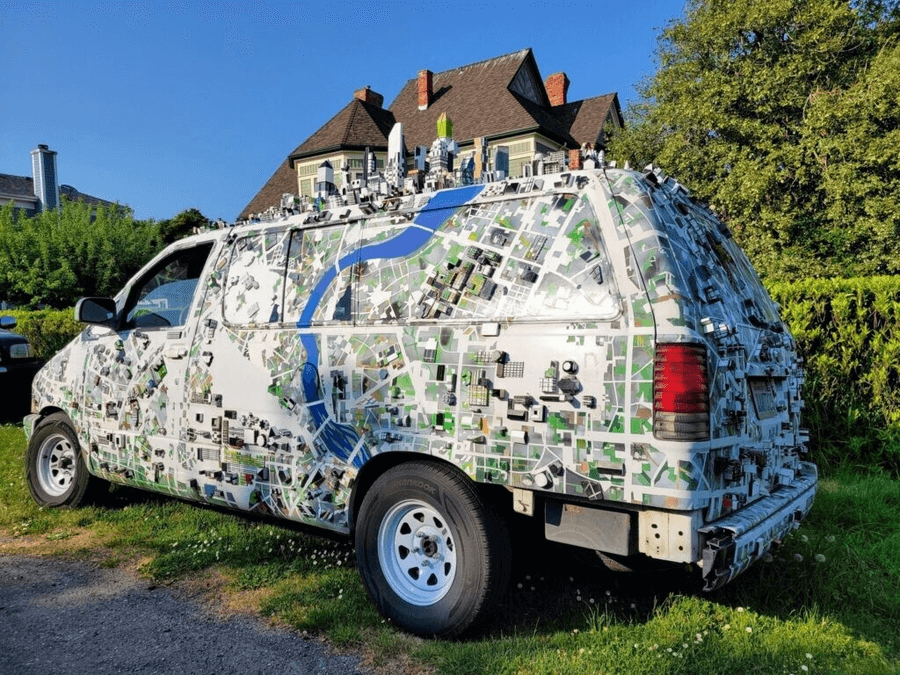

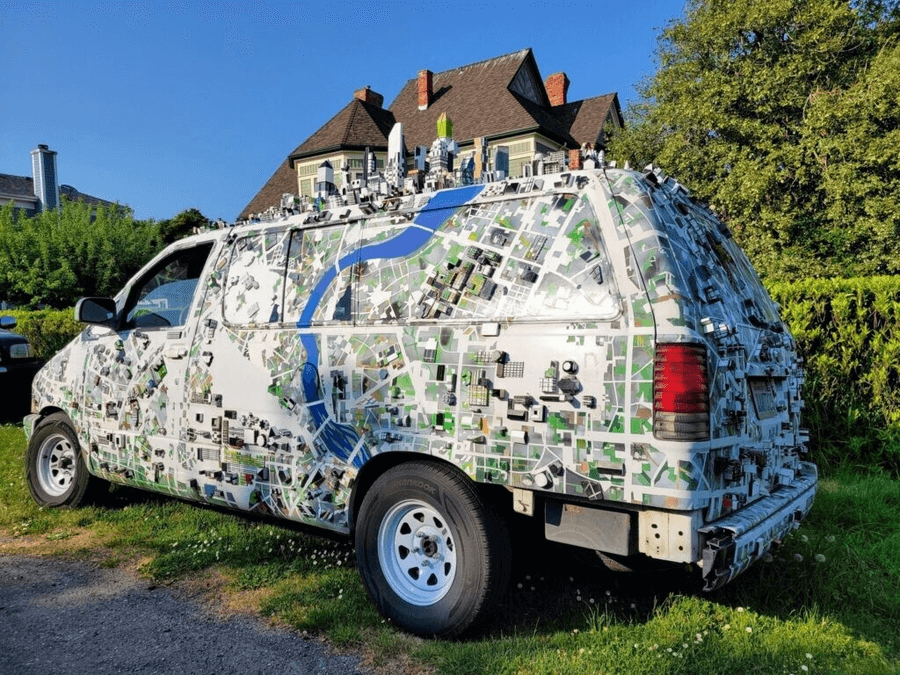

"Les cartes dépassent les frontières de l’art et de la technologie. La construction de ma base de données en ligne de 125 000 cartes est devenue une œuvre d’art en soi : un collage d’éléments visuels reliés par des chemins menant à des lieux inattendus" [https:]]Articles connexes

Geonames, une base mondiale pour chercher des noms de lieux géographiques

Les nouvelles perspectives offertes par la cartographie des odonoymes et autres toponymes

Une carte des suffixes les plus fréquents par région des noms de villes françaises

Les monts de Kong en Afrique : une légende cartographique qui a duré près d'un siècle !

La Lémurie : le mythe d'un continent englouti. La cartographie entre science et imaginaire

L'histoire de La Réunion par les cartesL'histoire par les cartes : 18 globes interactifs ajoutés à la collection David Rumsey

Des cadres qui parlent : les cartouches sur les premières cartes modernes

Comment géoréférencer une carte disponible dans Gallica ?

-

sur Séminaire, octobre 2022

Publié: 31 August 2023, 10:13am CEST par admin

Brainstorming, ateliers de travail, balade en fat bike sur la plage…

L’air marin a permis aux collaborateurs de faire émerger de nouvelles idées qui confirment la vision commune des deux entreprises.

Retour en images sur le séminaire organisé pour les équipes de GEOFIT GROUP et de NEOGEO.

-

sur Atelier avec le SMEAG

Publié: 31 August 2023, 10:13am CEST par admin

En janvier dernier s’est déroulé un atelier avec les équipes du SMEAG – Syndicat Mixte d’Études et d’Aménagement de la Garonne.

L’objectif était de présenter la maquette réalisée dans le cadre de la refonte de leur site internet. Le résultat a été très ???????, les personnes présentes ont approuvées le parcours utilisateur et le design associé.

Nos équipes de production travaillent désormais sur la ????????????? et le ?????????????? du site.

-

sur OneGeo Suite, interview GIP ATGERI

Publié: 31 August 2023, 10:09am CEST par admin

Lors des Geo Data Days 2022, nous avons eu l’occasion d’interviewer AnneSAGOT Responsable du Pôle PIGMA, et Emeric PROUTEAU, Référent technique, à propos de la mise en place d’une nouvelle plateforme de données en Nouvelle-Aquitaine.

Ce projet, porté par nos équipes et le GIP ATGeRi, s’est passé «?????? ??? ??? ????????? », malgré les contraintes et imprévus que l’on vous laisse découvrir…

-

sur L’Open Source

Publié: 31 August 2023, 10:08am CEST par admin

Chez Neogeo, nous marchons à l’Open Source ! Mais qu’est ce que l’Open Source ?

En quelques slides, découvrez l’un de nos domaines d’expertise.

-

sur Deviner la Tchéquie

Publié: 31 August 2023, 10:07am CEST par Françoise Bahoken

Contexte de la recherche : Préambule : Ce travail s’inscrit dans un axe de recherche du projet Tribute to Tobler – TTT portant sur l’application des méthodes d’algèbre linéaire à l’analyse des matrices origine-destination dans un objectif de cartographie thématique.

Préambule : Ce travail s’inscrit dans un axe de recherche du projet Tribute to Tobler – TTT portant sur l’application des méthodes d’algèbre linéaire à l’analyse des matrices origine-destination dans un objectif de cartographie thématique.

Ce billet contextualise, commente et présente après en français (après une traduction libre) le Notebook Guessing Czechoslovakia [accéder] réalisé par Philippe Rivière (Visions Carto) pour le #30DayMapChallenge de 2021 : Day22-Boundaries.L’objectif dans lequel s’inscrit ce travail consiste à examiner – suite à une demande de Waldo Tobler lui-même – les conditions théoriques et méthodologiques du transfert des méthodes de l’algèbre linéaire, des valeurs propres et autres décompositions spectrales à l’analyse cartographique des interactions territoriales.

Deux objectifs pour l’usage de l’algèbre linéaire pour cartographier des interactions spatiales/territoriales sont définis :- Le premier vise à simplifier la matrice origine-destination à représenter de manière à ce que la carte des interactions territoriales représentées entre des entités ne subisse pas d’effet spaghetti.

Tobler avait lui-même déjà commencé à examiner ce premier objectif, en reprenant l’un des papiers qu’il considérait comme précurseur de ce transfert, l’article de Peter Gould (1967), On the Geographical Interpretation of Eigenvalues, Transactions of the Institute of British Geographers, 42, p. 53-86. Vu l’intérêt de cet article, Laurent Beauguitte et moi-même l’avons traduit en français dans le cadre du groupe fmr (flux, matrices, réseaux) [Voir la présentation]. La version française et commentée par nos soins de ce texte de Peter Gould est disponible dans la collection HAL du groupe fmr : Sur l’interprétation géographique des valeurs propres.

Tobler a mobilisé pour cela les données de flux de dollars construites par S. Pi pour examiner cette méthode et proposer un ensemble de cartes de flux.

Les méthodes de décomposition spectrale utilisées en algèbre linéaire nous étant assez difficiles à comprendre au premier abord, nous avions des doutes quant à l’intérêt de ce transfert, s’il était effectivement pertinent sur le plan thématique de les utiliser pour cartographier des migrations par exemple.

L’investigation menée sur le premier objectif a ainsi conduit à reproduire la méthode sur le cas américain dans le cadre de TTT, et plusieurs collègues s’y sont attelés.

- Le second objectif consiste à révéler des partitions territoriales issues d’une régionalisation/clustering par des flux, c’est-à-dire de mettre en évidence des régions définies par un ensemble de flux observés entre des entités géographiques de niveau inférieur qui échangent plus entres elles, parce qu’elles appartiennent à une même région, qu’avec des entités de même niveau/échelle géographique mais qui appartiennent à une autre région.

C’est ce second objectif qui est examiné ici.

A la recherche d’anciennes partitions territorialesPour investiguer sur la proposition de Tobler, j’avais décidé de la mettre en œuvre sur les données de flux inter districts de l’ex-Tchécoslovaquie (1990). La raison était simple : je connaissais assez bien cette matrice pour l’avoir longuement manipulée dans la première partie de ma thèse et il (me) serait probablement plus facile de (me) (géo)visualiser les résultats obtenus pour évaluer la méthode en première instance, plutôt que d’essayer de comprendre d’emblée les systèmes d’équations sous-jacents. La cartographie servant ici à comprendre les résultats de travaux en cours ou exploratoires comme ceux présentés ici.

L’hypothèse examinée ici est donc de savoir s’il est possible (avec cette méthode qui permettait de partitionner l’espace à partir de valeurs de flux) de retrouver d’anciennes partitions territoriales antérieures à l’ex-Tchécoslovaquie de 1990, en l’occurrence d’anciennes républiques ou d’anciennes régions. La validation de cette hypothèse pourrait alors faire apparaître la méthode comme potentiellement complémentaire à celles plus traditionnelles en SHS de modélisation des interactions qui s’attachaient à mettre en évidence le rôle des frontières en termes d’ajustement des valeurs de flux (voir notamment les travaux de Nadine Cattan, de Claude Grasland et d’Athanase Bopda sur le sujet).

[Le texte qui suit à été rédigé en anglais par Philippe Rivière, mes ajouts ou commentaires à la traduction sont placés entre crochets].

Ce jeu de données – fourni par Françoise Bahoken dans le cadre du projet Tribute to Tobler représente le mouvement des personnes entre les 114 districts de l'(ex-)Tchécoslovaquie. Il s’agit d’une matrice origine/destination, où le CODEi est un identifiant du district d’origine, le CODEj un identifiant du district de destination, et Fij le flux (nombre de personnes qui se sont déplacées) de i à j au cours de l’année 1990.

Source : Pohyb Obyvatelstva, 1990.

Ces données ont été préparées par Claude Grasland.[L’intérêt d’utiliser ces données tient à ce qu’elles représentent un cas d’école pour examiner le rôle des frontière dans l’ajustement des interactions spatiales et/ou dans la différenciation des différentes régions et districts. La répartition géographique de ces districts (okrej) qui date de 1961 signe en effet l’évolution des frontières historiques de l’ex-Tchécoslovaquie de 1990 : les trois anciennes républiques Tchèque, Morave et Slovaque) elles-mêmes subdivisées en dix régions (kraj) au cours du temps sont visibles sur la partition territoriale de 1990.]

Question : Ces informations sont-elles suffisantes pour réaliser une carte [de flux] de la Tchécoslovaquie ?

Parmi les nombreuses méthodes possibles – en suivant, encore une fois, une suggestion de Waldo Tobler – nous pouvons essayer d’utiliser une méthode de réduction de dimension de la matrice. Dans ce cas, nous allons appliquer la méthode UMAP, de Leland McInnes, aisément disponible en JavaScript et empaquetée par René Cutura dans DruidJS.

La matrice brute est passée dans UMAP ; les résultats obtenus correspondent à des positions XY dans un espace virtuel.Voici ma carte ! OK … mais vous auriez raison de me poser la question suivante : est-ce que cela ressemble vraiment à la Tchécoslovaquie ? Eh bien, voici un tableau de données complémentaires qui identifie les régions/républiques historiques de chacun des districts : la variable “rep” contient C/S pour Tchéquie/Slovaquie, et “his” contient B/M/S pour Bohème/Moravie/Slovaquie.

Nous pouvons alors colorer les districts, sur la carte issue de UMAP, en fonction de ces deux variables :

Carte des deux anciennes républiques Tchèque et Slovaque

Carte des trois anciennes républiques : Tchéquie, Moravie et Slovaquie

– UMAP version 1 –Une erreur évidente est que la carte n’est pas [projetée dans un espace géographique et ni] correctement orientée (la Slovaquie, en rouge, est au sud-est.). À part cela, c’est plutôt bien fait !

[La méthode UMAP permet bien de retrouver le découpage historique en trois républiques de l’ex-Tchécoslovaquie, ce qui valide l’hypothèse de départ. Yes!].Carte des trois anciennes républiques : Tchéquie, Moravie et Slovaquie

– UMAP version 2 –Il est possible que les trois républiques historiques puissent facilement être identifiées à partir de ces seules données de migrations résidentielles avec un simple algorithme de regroupement (CK-means), appliqué à l’UMAP unidimensionnel de la matrice, [pour retrouver d’anciennes partitions].

Carte des trois anciennes républiques : Tchéquie, Moravie et Slovaquie

– variante clustering K-means –La méthode fonctionne également !

Enfin, nous devons confronter les coordonnées obtenues aux positions réelles des districts sur le terrain. Pour cela, nous allons simplement colorer les districts en fonction du clustering unidimensionnel UMAP, [en les projetant dans l’espace géographique muni des frontières des deux/trois républiques historiques].

Carte des trois anciennes républiques : Tchéquie, Moravie et Slovaquie

– variante UMAP géolocalisée –D’accord, [en y regardant de plus près], nous avons un peu de confusion, mais dans l’ensemble, ce n’est pas si mal ! L’utilisation d’une mesure de distance plus appropriée (comme la distance cosinus), le regroupement de l’UMAP dans des dimensions plus élevées, avec une méthode de clustering plus intéressante que CKmeans, pourrait nous aider à résoudre ce problème… mais ce sera pour un autre Notebook.

[Autres variantes présentées dans le notebook, mais non satisfaisantes]

Voir aussi :

TTT dans NeocartoLa collection TTT des travaux en français de et après Tobler : hal.archives-ouvertes.fr/TTT/

L’espace de travail collaboratif de TTT : ./tributetotobler/Géographe et cartographe, Chargée de recherches à l'IFSTTAR et membre-associée de l'UMR 8504 Géographie-Cités.

-

sur La pollution de l'air est la première menace mondiale pour la santé humaine (rapport de l'EPIC, août 2023)

Publié: 30 August 2023, 1:01pm CEST

« La majeure partie de la planète respire un air insalubre, ce qui réduit de plus de deux ans l'espérance de vie dans le monde » (rapport de l'EPIC, août 2023)Selon un rapport de l'Institut de politique énergétique de l'université de Chicago (EPIC) sur la qualité de l'air au niveau mondial, la pollution aux particules fines – émises par les véhicules motorisés, l'industrie et les incendies – représente « la plus grande menace externe pour la santé publique » mondiale. Ce rapport, publié le 29 août 2023, montre que les régions du monde les plus exposées à la pollution de l’air sont celles qui reçoivent le moins de moyens pour lutter contre ce risque.

« L'essentiel de son impact sur l'espérance de vie mondiale est concentré dans six pays seulement », précise le rapport : le Bangladesh, l'Inde, le Pakistan, la Chine, le Nigeria et l'Indonésie. La capitale de l’Inde, New Delhi, fait figure de « mégalopole la plus polluée du monde », avec un taux moyen annuel de 126,5 ?g /m³. A l’inverse, la Chine, a « fait de remarquables progrès dans sa lutte contre la pollution atmosphérique » initiés en 2014, souligne Christa Hasenkopf, directrice des programmes sur la qualité de l’air de l’EPIC. La pollution moyenne de l’air dans le pays a ainsi diminué de 42,3 % entre 2013 et 2021, mais reste six fois supérieure au seuil recommandé par l’OMS. Si ces progrès se poursuivent dans le temps, la population chinoise devrait gagner en moyenne 2,2 ans d’espérance de vie. De nombreux pays pollués manquent d'infrastructures de base pour lutter contre la pollution de l'air. L'Asie et l'Afrique en sont les deux exemples les plus poignants. Ils représentent 92,7 % des années de vie perdues à cause de la pollution. Pourtant, seuls 6,8 % et 3,7 % des gouvernements d'Asie et d'Afrique, respectivement, fournissent à leurs citoyens des données totalement ouvertes sur la qualité de l'air.

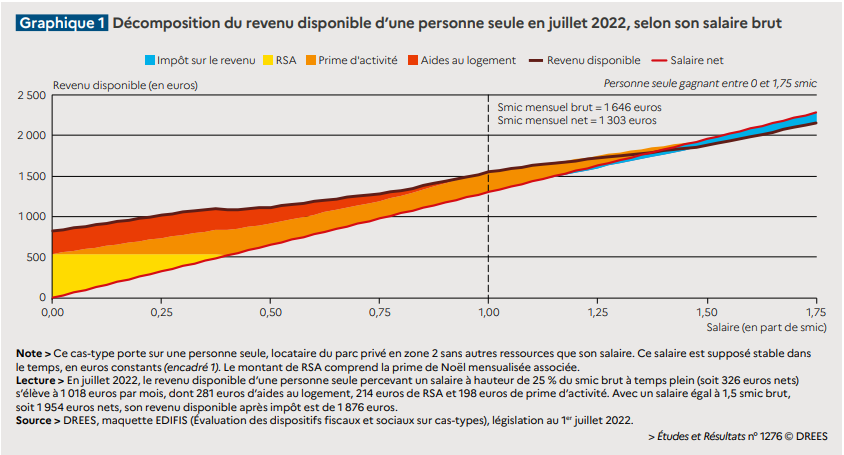

Évolution de la pollution aux particules fines PM 2,5 par région entre 1998 et 2021 (source : rapport de l'EPIC, août 2023)

À côté, l'Europe fait presque figure de bonne élève. « Les habitants sont exposés à environ 23,5 % de pollution en moins qu'en 1998 ». Malgré cette amélioration notable, ce n'est pas suffisant : la presque totalité du continent « ne respecte toujours pas les nouvelles lignes directrices de l'OMS ». De plus, « la pollution est nocive pour la santé humaine, même aux faibles niveaux qui existent aujourd'hui dans la majeure partie des États-Unis et de l'Europe », précise le rapport. Selon les chercheurs américains, l'espérance de vie moyenne dans le monde augmenterait de 2,3 ans si les normes de l'Organisation mondiale de la santé (OMS) - une exposition annuelle inférieure à 5 µg/m3 de PM 2,5 - étaient respectées. Ainsi, l'impact de la pollution aux particules fines sur l'espérance de vie est supérieur au tabac. En comparaison, l'alcool fait trois fois moins de dégâts, les accidents de voiture cinq fois, et le VIH/Sida sept fois.

Outre les rapports publiés sur l'indice d'espérance de vie lié à la qualité de l'air (AQLI) à l'échelle mondiale, le site de l'EPIC propose des cartes et des graphiques interactifs. L'un d'eux porte sur le gain potentiel en espérance de vie si l'on respirait de l'air pur. La carte interactive est assortie d'une chronologie qui permet de mesurer les évolutions dans le temps.

Combien de temps en plus pourriez-vous vivre si vous respiriez de l'air pur ? (voir la carte interactive sur le site de l'EPIC).jpg)

Pour en savoir plus sur la méthodologie utilisée pour mesurer l'Indice d'espérance de vie lié à la qualité de l'air (AQLI), voir : [aqli.epic.uchicago.edu]

Lien ajouté le 20 septembre 2023

Carte interactive pour conduire des comparaisons de la pollution de l'air par région [https:]] pic.twitter.com/yuRIwCPlLv

— Sylvain Genevois (@mirbole01) September 20, 2023Articles connexes

Pollution de l'air et zones urbaines dans le monde

Quels sont les États qui ont le plus contribué au réchauffement climatique dans l’histoire ?

Les plus gros émetteurs directs de CO2 en FranceQuand la carte du dioxyde d'azote (NO2) crée comme une ombre fantomatique de l'humanité

Qualité de l'air et centrales thermiques au charbon en Europe : quelle transition énergétique vraiment possible ?L'empreinte carbone des villes dans le monde selon le modèle GGMCF

Le tourisme international et son impact sur les émissions de CO?

Des cartes pour alerter sur la pollution de l'air autour des écoles à Paris et à Marseille

-

sur Photogrammar, une collection de photographies prises aux États-Unis entre 1935 et 1943

Publié: 28 August 2023, 5:33pm CEST

Photogrammar fournit une plate-forme de visualisation pour explorer les 170 000 photographies prises entre 1935 et 1943 par les agences Farm Security Administration (FSA) et l’Office of War Information (OWI) du gouvernement fédéral américain. Le projet est maintenu par le Digital Scholarship Lab et le Distant Viewing Lab de l'Université de Richmond.

On y trouve des scènes de la vie quotidienne pendant la Grande Dépression et la Seconde Guerre mondiale. Même si le soutien aux politiques du New Deal était un objectif explicite, les objectifs du projet dépassaient l’opportunisme bureaucratique. Stimulés par l'intérêt des sciences sociales contemporaines pour la compréhension de la vie quotidienne des gens ainsi que par leur intérêt pour l'élaboration des archives historiques de l'époque, Stryker et les photographes de l'unité ont élargi le projet pour en faire un projet de documentation de l'Amérique.

Interface de navigation de la plateforme Photogrammar

L'interface du site permet différents parcours de découverte en utilisant la carte ou la chronologie, ou encore en effectuant des recherches par thèmes, par photographes, par Etats ou par villes.

Accès par thèmes aux photographies de Photogrammar

On y trouve notamment le travail de Dorothea Lange, dont les photographies poignantes des sans-abris a attiré l'attention de la Resettlement Administration devenue plus tard la Farm Security Administration, qui la recrute comme photographe officielle en 1935. Mais les photos de Walker Evans, l'une des plus grandes figures humanistes de la photographie du XXe siècle.Articles connexes

Plus de 400 000 photographies aériennes mises en ligne par les archives historiques de l'Angleterre

L'histoire par les cartes : les photographies de la Commission du Vieux Paris

Pour aider à géolocaliser des photographies, Bellingcat propose un outil de recherche simplifié à partir d'OpenStreetMap

Des images aériennes déclassifiées prises par des avions-espions U2 dans les années 1950 ouvrent une nouvelle fenêtre pour l'étude du Proche-Orient

Annoter et partager des images et des cartes numériques en haute résolution en utilisant des outils IIIF

Manga Map, une application qui transforme vos vues aériennes en images de type bande dessinée

-

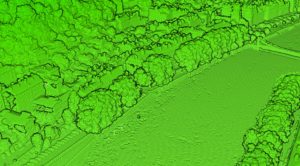

sur Les dernières nouveautés Giro3D

Publié: 28 August 2023, 2:57pm CEST par Sébastien Guimmara

Dans un précédent article, nous vous présentions les dernières évolutions et la roadmap de Giro3D. Dans cet article, nous vous présentons les dernières nouveautés du projet.

Quoi de neuf dans Giro3D ?La dernière version de Giro3D ajoute de nombreuses fonctionnalités, améliorations et correctifs. Voici un aperçu des principales additions.

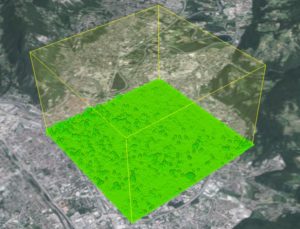

Effets de nuages de points ( Essayer en ligne)

Un élément important de la roadmap concerne l’amélioration du rendu des nuages de points. L’ajout d’effets comme l’Eye Dome Lighting (EDL) et inpainting améliore grandement la lisibilité et l’aspect visuel des nuages de points. Ces effets font désormais partie du coeur de Giro3D et peuvent être activés à la demande au runtime.

Essayer en ligne)

Un élément important de la roadmap concerne l’amélioration du rendu des nuages de points. L’ajout d’effets comme l’Eye Dome Lighting (EDL) et inpainting améliore grandement la lisibilité et l’aspect visuel des nuages de points. Ces effets font désormais partie du coeur de Giro3D et peuvent être activés à la demande au runtime.

Eye dome lighting sur un nuage de points

Reprojection des couches images ( Essayer en ligne)

L’entité Map peut désormais contenir des couches dont la projection diffère de celle de la scène. Dans ce cas, les images produites par les couches sont automatiquement reprojetées pour correspondre au système de coordonnées de la scène.

C’est particulièrement utile dans le cas où vous ne pouvez pas changer le système de coordonnées de la scène, (par exemple si la scène contient d’autres entités non reprojetables), ou pour mélanger des couches de fournisseurs différents (et de projections différentes).

Nouvelle entité: FeatureCollection (

Essayer en ligne)

L’entité Map peut désormais contenir des couches dont la projection diffère de celle de la scène. Dans ce cas, les images produites par les couches sont automatiquement reprojetées pour correspondre au système de coordonnées de la scène.

C’est particulièrement utile dans le cas où vous ne pouvez pas changer le système de coordonnées de la scène, (par exemple si la scène contient d’autres entités non reprojetables), ou pour mélanger des couches de fournisseurs différents (et de projections différentes).

Nouvelle entité: FeatureCollection ( Essayer en ligne)

FeatureCollection permet d’afficher des données vectorielles directement sous forme 3D, sans passer par un drapage sur la Map. Les types de vecteurs supportés sont : points, polylignes et (multi-)polygones.

Nous travaillons actuellement au support des polygones extrudés pour l’affichage de bâtiments en 3D.

Essayer en ligne)

FeatureCollection permet d’afficher des données vectorielles directement sous forme 3D, sans passer par un drapage sur la Map. Les types de vecteurs supportés sont : points, polylignes et (multi-)polygones.

Nous travaillons actuellement au support des polygones extrudés pour l’affichage de bâtiments en 3D.

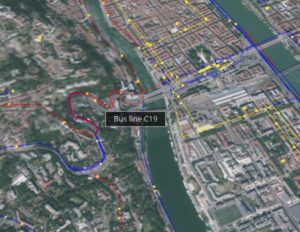

2 couches WFS (arrêts de bus et lignes de bus) affichés sous forme de meshes 3D.

Support des plans de coupes ( Essayer en ligne)