10èmes Rencontres Géopolitiques de Trouville-sur-Mer (septembre 2025)

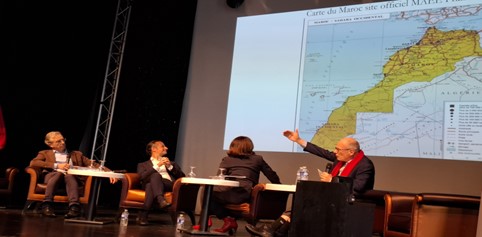

Ce ne sont pas uniquement les amateurs de longues plages de sable, ni les nostalgiques de Marguerite Duras qui se sont retrouvés à Trouville-Sur-Mer ce dernier week-end de septembre, mais aussi les passionnés de géopolitique. La station normande accueillait en effet les 10èmes Rencontres Géopolitiques, conçues et animées par Frédéric Encel, géopolitologue et essayiste. Pour y assister, pas besoin d’inscription, de QR Code, ni d’achat de billet. Les tables rondes, animées par des universitaires, diplomates, journalistes… sont ouvertes à tous. Cette année, les travaux portaient sur « La France et l’Afrique » et, grande nouveauté, un pays était invité, le Maroc, représenté par son ambassadeure en France, Madame Samira Sitaïl.

...

![Faut-il corriger la carte du monde [en s’appuyant sur la projection de Mercator] ?](https://neocarto.hypotheses.org/files/2025/09/TV5MondeAfrique_logo.png)

![[La Minute GeoRezo] SIG 2025, RDV aux Docks de Paris les 8 et 9 octobre](https://blog.georezo.net/laminute/files/2026/01/ESRI_SIG2025-e1768040656794.png?t=1758174330&w=500&h=150&tok=2c8cea)

![[Équipe Oslandia] Bertrand Parpoil, CEO](https://s.w.org/images/core/emoji/11/72x72/1f642.png)